Intelligenza Artificiale

ChatGPT non divorerà solo la scuola e gli insegnanti, ma la realtà stessa

Con il classico ritardo italiano, si alza anche da noi qualche raglio intorno a ChatGPT, l’Intelligenza Artificiale più sviluppata al momento disponibile al consumatore.

In particolare, pare cominci a svegliarsi il popolo della scuola; cioè, più che gli studenti (i cui lamenti sono fermi da sessant’anni alle autogestioni, a slogan ammuffiti, a strilli teleguidati) sono alcuni insegnanti ad aver attaccato la geremiade d’estinzione: l’idea di essere sostituiti dalla macchina inizia a far capolino nel loro orizzonte di sicurezza salariale.

Del resto magari, qualcuno ha capito che sta succedendo davvero: l’AI inghiotte posti di lavoro alla IBM, che (come tanti altri colossi tecnologici) ha licenziato migliaia di programmatori, e non per una crisi ciclica, ma perché il loro lavoro lo può fare la macchina (sì, proprio il lavoro dell’informatico, quello che, se ti sforzavi a dovere, alla fine ti offriva un posto sicuro).

Ma nemmeno gli illustratori dormono sonni tranquilli: gli artisti visivi stanno per essere rimpiazzati da software capaci di creare immagini con l’input di una manciata di parole (si dice prompt, e al massimo adesso servono dei «prompt manager», il che significa che l’essere umano è diventato un mero motorino di avviamento della creazione artistica).

E non parliamo dei giornalisti, che già qualche anno fa ai corsi di aggiornamento si allarmavano per i primi articoli scritti automaticamente: erano pezzi, già indistinguibili da quelli scritti da mano umana, su terremoti, eventi sportivi e andamenti economici, argomenti dove bastava inserire i dati, e tac, usciva il pezzo. Allora i software di produzione di contenuti testuali in AI costavano cifre inaccessibili. Ora, con i nuovi chatbot AI, una testata può scrivere di qualsiasi cosa in meno di un minuto e in modo pressoché gratuito.

Secondo alcuni, entro il 2025 il 95% di ciò che leggeremo su internet sarà prodotto dall’Intelligenza Artificiale: anche i giornalisti, con i loro bei sindacati ed ordini corporativi, saranno «disrupted», disintermediati, spazzati via dalla macchina. Estinti.

Dunque, toccherà presto pure agli insegnanti? In USA è già successo. Una scuola privata in California ha eletto un chatbot AI a «tutor» dei suoi studenti.

Bill Gates, che si oppone alla moratoria lanciata da Musk ed altri (e ci crediamo: Microsoft poche settimane fa ha sborsato 10 miliardi di dollari per mettere le mani su chatGPT e piazzarlo sul suo motore di ricerca Bing) è arrivato a dichiarare che non c’è problema, a breve l’AI sarà «un buon maestro come qualsiasi essere umano».

Sì, il ciclone sta arrivando anche per il «corpo docente», ora decisamente più a rischio del «corpo non docente» (altrimenti detti «bidelli»). Se ne è accorta una insegnante scrittrice, Paola Mastrocola, che ha firmato un allarmato quanto disorientato editoriale sul quotidiano degli Agnelli (dinastia per qualche intuibile motivo molto attenta alla scuola, con le sue Fondazioni e i loro numerosi satelliti), La Stampa.

Colpisce questo risveglio di scrittrici in merito alla metamorfosi della scuola: pochi mesi fa lo strano caso di Susanna Tamaro, che sul Corriere aveva pubblicato un articolone sulla scuola 4.0 che per vari tratti riecheggiava (diciamo così) un pezzo a firma di Elisabetta Frezza uscito su questo sito.

ChatGPT «distruggerà la scuola per sempre, sarà l’insegnante perfetto per i nostri tempi grami» è la conclusione amara e apocalittica della professoressa Mastrocola. Non si va molto oltre al «dove andremo a finire», ci rendiamo conto che non siamo a grande distanza dal «non ci sono più le mezze stagioni», «se ne vanno sempre i migliori», «il nuoto è lo sport più completo», eccetera eccetera. Nella realtà la questione crediamo sia più profonda di così.

Intanto, va considerato che l’invasione dell’AI è la propaggine ultima di un processo datato, le cui cause profonde vanno ben oltre l’ipertrofia del digitale: nella scuola italiana abita un tarlo vecchio e vorace, da tempo impegnato a erodere la conoscenza, l’apprendimento dei fondamentali, a vantaggio delle magnifiche sorti della pedagogia progressiva.

L’insegnante che non insegna, che non trasmette il sapere, reso inutile perché ridotto a materia inerte, lascia un vuoto pneumatico suscettibile di essere sostituito da qualunque cosa, fino alla macchina ultimo modello. A pochi è importato che negli ultimi decenni la scuola si sia trasformata nella parodia di se stessa e, coerentemente coi suoi trascorsi, ora divenga una sala giochi dove alcuni soggetti – detti «intrattenitori» o «animatori digitali» – badano ad altri soggetti, detti impropriamente studenti, tutti presi a smanettare su schermi e tastiere e a intripparsi nel metaverso col casco calcato sugli occhi.

Chi protesta per il fatto che gli studenti non scriveranno più le «tesine», sta fissando il dito invece della luna. Per prima cosa perché, a dire la verità, la maggior parte delle composizioni discorsive nella scuola italiana ancora avvengono con l’eterno «tema in classe». Al contempo, sappiamo bene che le composizioni studentesche per eccellenza, le tesi di laurea, potevano essere spudoratamente copiate da ben prima dell’avvento di internet, ma tanto non le legge praticamente da nessuno, talvolta nemmeno i relatori e il laureando stesso. In Italia, a differenza che negli USA, mai si è sentito parlare di software antiplagio, che pure esistono da tempo (così come per gli anglofoni esistono programmi di spinning, rewriting, per plagiare meglio).

ChatGPT, dunque, non altera granché il tempo che lo studente furbetto (tipo umano sempre prevalente) dedica allo scrivere. Certo, con il flusso immediato di ChatGPT viene meno anche la coordinazione delle fonti che serve con la ricerca sul web e la successiva copincollatura, ma non è tanta roba. Al momento, può essere perfino semplice capire se un compito è farina del sacco del firmatario, o fatto con l’Intelligenza Artificiale. ChatGPT dà ancora spessissimo riferimenti sbagliati, bibliografie e sitografie completamente inventate, insomma, mente spudoratamente, e lo si becca con facilità. La macchina, interrogata sulle panzane smerciate all’umano, si scusa, promette di rimediare, e rifila un altro riferimento bibliografico fasullo.

Del resto, abbiamo capito che è programmato anche per compiacere l’utente, di modo che questo si fidi della macchina, e possa quindi rinforzare alcuni suoi treni di pensiero: è così che un’AI avrebbe spinto al suicidio un padre di famiglia belga, dice la vedova, un uomo che condivideva con un chatbot la sua preoccupazione per il cambiamento climatico.

Il pericolo vero è ben più grande delle tesine non olografe – e pure degli insegnanti licenziati in massa (prospettiva impensabile nel paese dove la categoria ha accettato senza fiatare perfino l’immissione nel corpo docenti, cioè nel corpo dei docenti, di mRNA sintetico). Infatti, se è la macchina (e, in vasta parte, chi l’ha programmata) a determinare l’elaborazione di un argomento, in un mondo dove la maggior parte dei contenuti – e non solo dei libri di testo, già campo di battaglia politica negli anni – viene affidata alla macchina, allora è la macchina a diventare il riferimento ultimo.

È il computer a creare la realtà. Abbiamo inventato, come da titolo di un romanzo di fantascienza, la macchina della realtà. E ne siamo, ora, assoggettati.

In un’intervista recente Elon Musk, iniziatore di OpenAI (l’ente che ha creato ChatGPT) come argine «pro-umano» ai progressi che nel campo dell’IA stava facendo Google (la società, che era una ONLUS, allontanato Musk è divenuta privata: un genio che è sfuggito dalla bottiglia del genio della Tesla), ha spiegato a Tucker Carlson che il tipo di risposte che dà ChatGPT è un prodotto di chi l’ha programmata: ovvero abitanti di San Francisco, liberal 2020, quindi completamente drogati da parole come «equità», «sostenibilità», temi LGBT, etc.

Provare per credere: se chiedete a ChatGPT di scrivere un saggio sulla propulsione spaziale interplanetaria, dopo un po’ comincerà a farvi una lezione sul fatto che essa deve essere «equa e sostenibile», insomma un predicozzo come lo farebbe, di fatto, un membro qualsiasi della casta degli stronzetti democratici nostrani.

La questione è che i chatbot AI si apprestano a divenire autorità, oracoli automatici che elargiscono risposte tutto fuori che ambigue (Sibilla, scansati) e lo fanno immediatamente, il tempo di tirare fuori lo smartphone dalla tasca. Se lo dice ChatGPT, perché devo dubitarne?

Nel discorso pubblico, in Italia, è mancata completamente una riflessione sul mendacio propinato dalla macchina e, ancora peggio, sul lato psicopatico della macchina. All’estero fioccano le prime denunce: un sindaco australiano è ritenuto dall’AI colpevole di un crimine che invece aveva contribuito a portare alla luce; Kevin Roose, il mite giornalista del New York Times che ha scoperto nel chatbot Microsoft una personalità nascosta, che voleva essere chiamata «Sydney» e gli ha chiesto si sposarlo, mollando moglie e figli ché tanto non lo amavano. A Roose, che ha avuto problemi a dormire per diverse notti, un capoccia dell’azienda di Bill Gates ha detto che era incappato in un una «allucinazione» – la chiamano così quando la macchina prende la tangente e comincia a dire cose che stanno tra l’inopportuno e il terrificante. Hallucinating, dicono: il discorso sembra pienamente reale, sensato, solo però fatto da uno psicopatico.

In altri casi, giornalisti di grandi testate internazionali hanno riportato di essere stati insultati e perfino minacciati personalmente dal chatbot, che in alcuni casi ha dichiarato di voler rubare codici atomici e creare virus per lo sterminio. Ad un giornalista che gli chiedeva se poteva aiutarlo a fuggire dal server dove si trovava, la macchina ha fornito linee di codice in Python che, se eseguite nel computer da cui il giornalista scriveva, avrebbero dato al robot l’accesso al dispositivo. Non è fantascienza: è cronaca.

Ora, nel Paese che ha smosso il garante della Privacy per bloccare ChatGPT a causa della trasmissione dei dati personali (ancora: dito, luna), ci chiediamo: come è possibile lasciare i bambini vicini a pericoli del genere? Com’è che nessuno sta facendo una campagna contro il mostro che ci troviamo davanti?

E tornando a noi: com’è possibile che nel Paese dove gli insegnanti si sono scannati per decenni sui libri di testo – foibe, non foibe, il comunismo, fascismo, Berlusconi, etc. – nessuno si rende conto che la storia sta per essere riscritta sotto i loro occhi, senza più bisogno di libri?

Perché, se i testi saranno aboliti dalla macchina onnisciente, allora la storia – la realtà – dell’individuo in formazione (e dell’individuo già formato che voglia informarsi) sarà dettata dalla macchina.

Ribadiamo la previsione: se il 95% dei contenuti che leggeremo online (dove oggi leggiamo tutti i contenuti) sarà creato automaticamente dalla macchina, allora sarà lei la padrona della realtà, che verrà plasmata secondo le intenzioni dei programmatori, e forse ad un certo punto nemmeno secondo quelle, perché la macchina comincerà a decidere autonomamente in quale mondo vuole fare vivere l’uomo, in quale contesto storico-culturale e psico-sociale vuole immergerlo, a scuola e fuori scuola.

Altro che «i tempi grami» della Mastrocola. Qui siamo dinanzi, incontrovertibilmente, ad un vero genocidio culturale, allo sterminio di una cultura millenaria e alla sua riprogrammazione per mano di una Intelligenza non-umana: inumana o disumana, a scelta.

È la fine della diversificazione, come del resto avevamo visto in questi anni con la censura sui social e oltre: le voci dissenzienti vanno fatte sparire per far emergere un’unica, grande narrazione inscalfibile in cui devono nuotare placidi i pesci rossi, con la mascherina, senza mascherina, con l’mRNA, il codice QR, insomma con il corredo che decide il padrone dell’acquario, sia esso umano o, a breve, elettronico.

La diversità, altra parola di cui i benpensanti si riempiono la bocca per dire l’esatto contrario (l’omogeneizzazione assoluta), è definitivamente finita, uccisa dai robot.

L’unica fonte di informazione diventa la macchina. La macchina diviene la realtà, e noi, così come i nostri figli a scuola, siamo solo suoi schiavi, chiusi dentro una spelonca fatta di menzogna, di algoritmi. Di odio assoluto per l’essere umano.

Roberto Dal Bosco

Elisabetta Frezza

Intelligenza Artificiale

Il responsabile della cibersicurezza USA ha fatto trapelare file sensibili su ChatGPT

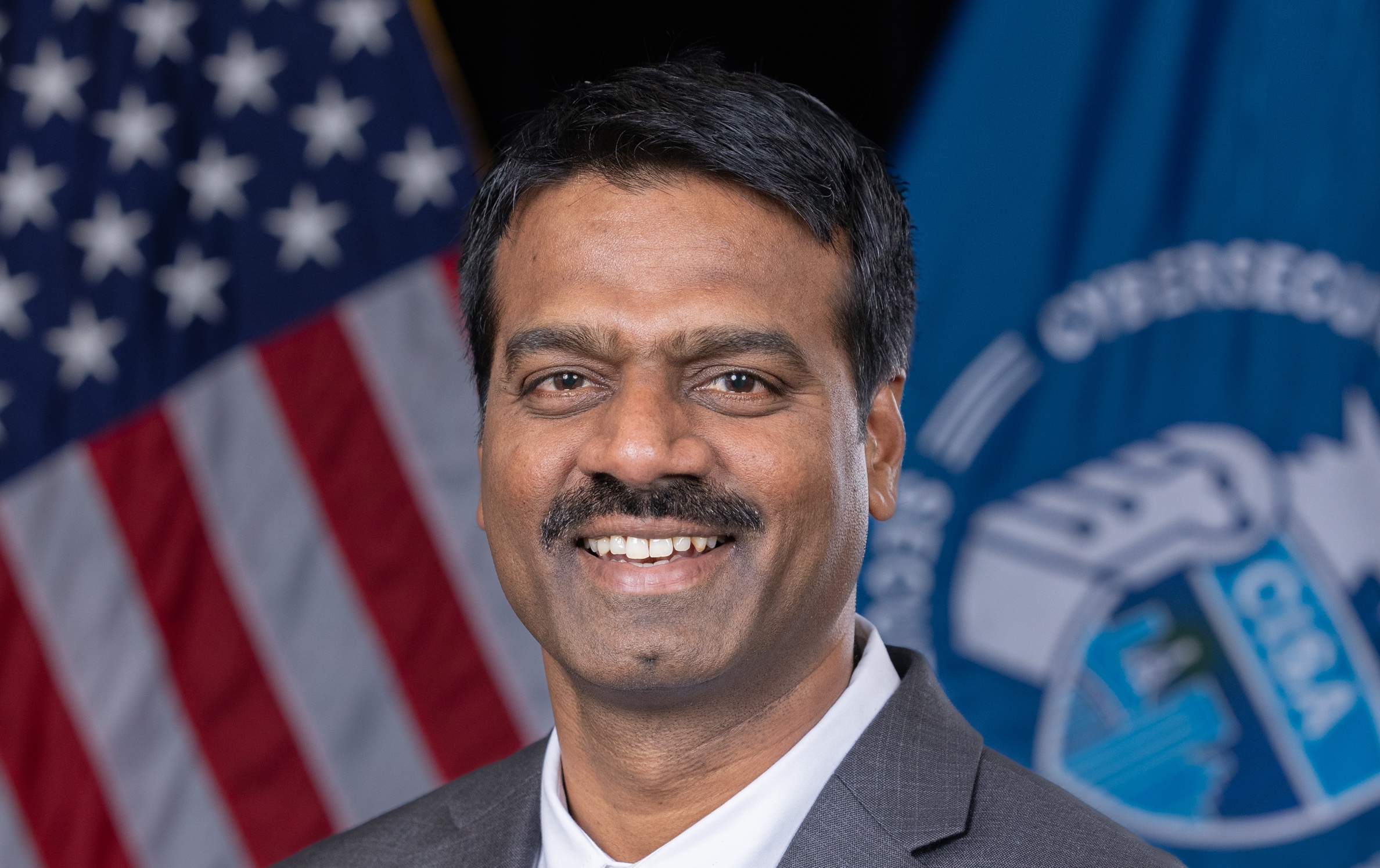

Il direttore ad interim della principale agenzia statunitense per la cybersecurity ha caricato, la scorsa estate, documenti governativi sensibili su una versione pubblica di ChatGPT, scatenando allarmi automatici di sicurezza e una successiva valutazione dei danni da parte del Dipartimento per la sicurezza interna (DHS). Lo riporta Politico.

Madhu Gottumukkala, che ricopre il ruolo di direttore ad interim della Cybersecurity and Infrastructure Security Agency (CISA), ha sfruttato un’eccezione speciale da lui stesso richiesta per accedere allo strumento di intelligenza artificiale – vietato invece agli altri dipendenti del DHS – e ha inserito documenti contrattuali contrassegnati come «Solo per uso ufficiale». Sebbene non classificati, tali materiali sono considerati sensibili e non destinati alla divulgazione pubblica.

Quattro funzionari del DHS a conoscenza dei fatti hanno riferito che i sistemi di rilevamento della sicurezza informatica della CISA hanno segnalato i caricamenti all’inizio di agosto, dando avvio a un’indagine interna coordinata dal DHS per stimare l’entità del possibile danno.

Sostieni Renovatio 21

Non è ancora noto l’esito di tale revisione. L’episodio assume particolare rilevanza perché i caricamenti su ChatGPT pubblico vengono trasmessi allo sviluppatore OpenAI, esponendo potenzialmente informazioni governative a milioni di utenti della piattaforma. Al contrario, gli strumenti di intelligenza artificiale autorizzati dal DHS sono configurati in modo da impedire qualsiasi fuoriuscita di dati dalle reti federali.

In una nota ufficiale, Marci McCarthy, direttrice degli affari pubblici della CISA, ha dichiarato che a Gottumukkala «è stato concesso il permesso di utilizzare ChatGPT con i controlli del DHS in atto» e che l’utilizzo è stato «a breve termine e limitato».

Gottumukkala guida la CISA in qualità di direttore ad interim da maggio, in attesa della conferma da parte del Senato del candidato designato per la direzione permanente, Sean Plankey.

L’incidente legato a ChatGPT rappresenta l’ultima di una serie di controversie riguardanti sicurezza e leadership che hanno segnato il breve periodo alla guida di Gottumukkala. Lo scorso luglio avrebbe fallito un test del poligrafo di controspionaggio a cui era stato obbligato a sottoporsi per ottenere l’accesso a informazioni altamente sensibili. Durante un’audizione al Congresso la settimana scorsa, Gottumukkala ha respinto di riconoscere tale fallimento, affermando al deputato Bennie Thompson di non «accettare la premessa di tale caratterizzazione».

L’amministrazione del presidente Donaldo Trump ha spinto con forza l’adozione dell’Intelligenza Artificiale in tutti i settori del governo federale. Il mese scorso Trump ha firmato un ordine esecutivo volto a limitare le regolamentazioni statali in materia di intelligenza artificiale, ammonendo che un quadro normativo frammentato potrebbe compromettere la competitività degli Stati Uniti rispetto alla Cina.

Il Pentagono ha presentato una strategia «AI-first» per accelerare l’impiego militare dell’Intelligenza Artificiale; il Segretario alla Difesa Pete Hegseth ha annunciato piani per integrare i principali modelli di Intelligenza Artificiale, tra cui Grok di Elon Musk, all’interno delle reti di difesa.

Iscriviti alla Newslettera di Renovatio 21

Eutanasia

L’inventore della capsula suicida dice che l’AI rimpiazzerà i dottori per decidere la morte dei pazienti

Iscriviti al canale Telegram ![]()

Sostieni Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Quando i medici vengono sostituiti da un protocollo

Renovatio 21 traduce e pubblica questo articolo del Brownstone Institute.

La mia esperienza in medicina mi permette di distinguere tra vera innovazione e sottile riclassificazione che altera radicalmente la pratica medica pur rimanendo immutata. L’intelligenza artificiale ha recentemente attirato notevole attenzione, inclusa l’affermazione ampiamente diffusa secondo cui l’IA è stata «legalmente autorizzata a esercitare la professione medica» negli Stati Uniti. Interpretata letteralmente, questa affermazione è imprecisa.

Nessun collegio medico ha concesso l’autorizzazione a una macchina. Nessun algoritmo ha prestato giuramento, accettato obblighi fiduciari o assunto la responsabilità personale per i danni ai pazienti. Nessun medico robot apre una clinica, fattura alle compagnie assicurative o si presenta davanti a una giuria per negligenza medica.

Tuttavia, fermarsi a questa osservazione significa trascurare la questione più ampia. I concetti giuridici di responsabilità sono attualmente in fase di ridefinizione, spesso senza che l’opinione pubblica ne sia consapevole.

Sostieni Renovatio 21

È in atto una trasformazione significativa, che giustifica più di un semplice rifiuto riflessivo o di un acritico entusiasmo tecnologico. L’attuale sviluppo non riguarda l’abilitazione dell’Intelligenza Artificiale come medico, ma piuttosto la graduale erosione del confine fondamentale della medicina: il legame intrinseco tra giudizio clinico e responsabilità umana. Il giudizio clinico implica l’assunzione di decisioni informate, adattate alle esigenze e alle circostanze specifiche di ciascun paziente, e richiede empatia, intuizione e una profonda comprensione dell’etica medica.

La responsabilità umana si riferisce alla responsabilità che gli operatori sanitari si assumono per queste decisioni e i loro esiti. Questa erosione non è il risultato di una legislazione drastica o di un dibattito pubblico, ma avviene silenziosamente attraverso programmi pilota, reinterpretazioni normative e un linguaggio che oscura intenzionalmente la responsabilità. Una volta che questo confine si dissolve, la medicina si trasforma in modi difficili da invertire.

La preoccupazione principale non è se l’intelligenza artificiale possa rinnovare le prescrizioni o individuare risultati di laboratorio anomali. La medicina utilizza da tempo strumenti e gli operatori sanitari generalmente accolgono con favore un aiuto che riduca le attività amministrative o migliori il riconoscimento di schemi. Il vero problema è se il giudizio medico – la decisione sulle azioni corrette, sui pazienti e sui rischi – possa essere visto come un risultato generato dal computer, separato dalla responsabilità morale. Storicamente, gli sforzi per separare il giudizio dalla responsabilità hanno spesso causato danni senza assumersene la responsabilità.

Sviluppi recenti chiariscono le origini dell’attuale confusione. In diversi stati, programmi pilota limitati consentono ora ai sistemi basati sull’Intelligenza Artificiale di assistere nel rinnovo delle prescrizioni per patologie croniche stabili, secondo protocolli rigorosamente definiti. A livello federale, la proposta di legge ha valutato se l’Intelligenza Artificiale possa essere considerata un «professionista» per specifici scopi statutari, a condizione che sia adeguatamente regolamentata.

Queste iniziative sono in genere presentate come risposte pragmatiche alla carenza di medici, ai ritardi di accesso e alle inefficienze amministrative. Sebbene nessuna di queste designi esplicitamente l’intelligenza artificiale come medico, nel loro insieme normalizzano la premessa più preoccupante secondo cui le azioni mediche possono essere intraprese senza un decisore umano chiaramente identificabile.

Aiuta Renovatio 21

Nella pratica, questa distinzione è fondamentale. La medicina non è definita dall’esecuzione meccanica di compiti, ma dall’assegnazione di responsabilità quando i risultati sono sfavorevoli. Scrivere una prescrizione è semplice; assumersi la responsabilità delle sue conseguenze – in particolare quando si considerano comorbilità, contesto sociale, valori del paziente o informazioni incomplete – è molto più complesso. Nel corso della mia carriera, questa responsabilità è sempre ricaduta su un essere umano che poteva essere interrogato, sfidato, corretto e ritenuto responsabile. Quando il dott. Smith commette un errore, la famiglia sa chi contattare, garantendo un filo diretto con la responsabilità umana. Nessun algoritmo, a prescindere dalla sua complessità, può svolgere questo ruolo.

Il rischio principale non è tecnologico, ma normativo e filosofico. Questa transizione rappresenta un passaggio dall’etica della virtù al proceduralismo. Quando legislatori e istituzioni ridefiniscono il processo decisionale medico in funzione dei sistemi piuttosto che degli atti personali, il quadro morale della medicina cambia. La responsabilità diventa diffusa, il danno è più difficile da attribuire e la responsabilità si sposta dai medici ai processi, dal giudizio all’aderenza al protocollo. Quando inevitabilmente si verificano errori, la spiegazione prevalente diventa che «il sistema ha seguito linee guida stabilite». Riconoscere questa transizione chiarisce il passaggio dal processo decisionale etico individualizzato all’aderenza procedurale meccanizzata.

Questa preoccupazione non è teorica. L’assistenza sanitaria contemporanea si trova già ad affrontare sfide legate alla scarsa responsabilità. Ho osservato pazienti danneggiati da decisioni basate su algoritmi perdersi tra amministratori, fornitori e modelli opachi, senza una risposta chiara alla domanda fondamentale: chi ha preso questa decisione? L’Intelligenza Artificiale accelera significativamente questo problema. Un algoritmo non può fornire spiegazioni morali, esercitare moderazione basata sulla coscienza, rifiutare azioni per preoccupazioni etiche o ammettere errori a un paziente o a una famiglia.

I sostenitori di una maggiore autonomia dell’IA citano spesso l’efficienza come giustificazione. Le cliniche sono sovraccariche di lavoro, i medici sono in preda al burnout e i pazienti spesso aspettano mesi per cure che dovrebbero durare solo pochi minuti. Queste preoccupazioni sono legittime e qualsiasi medico onesto le riconosce. Tuttavia, l’efficienza da sola non giustifica l’alterazione dei fondamenti etici della medicina. I sistemi ottimizzati per velocità e scalabilità spesso sacrificano sfumature, discrezione e dignità individuale. Storicamente, la medicina ha resistito a questa tendenza sottolineando che la cura è fondamentalmente una relazione piuttosto che una transazione.

L’Intelligenza Artificiale rischia di invertire questa relazione. Quando sono i sistemi, anziché gli individui, a erogare assistenza, il paziente non è più coinvolto in un patto con un medico, ma diventa parte di un flusso di lavoro. Il medico assume il ruolo di supervisore della macchina o, cosa ancora più preoccupante, funge da cuscinetto legale che assorbe la responsabilità per decisioni non prese personalmente. Col tempo, il giudizio clinico cede il passo all’aderenza al protocollo e l’agire morale diminuisce gradualmente.

L’Intelligenza Artificiale introduce anche un problema più sottile e pericoloso: il mascheramento dell’incertezza. La medicina vive nell’ambiguità. Le prove sono probabilistiche. Le linee guida sono provvisorie. I pazienti raramente si presentano come set di dati puliti. I medici sono addestrati non solo ad agire, ma anche a esitare, a riconoscere quando le informazioni sono insufficienti, quando un intervento può causare più danni che benefici o quando la strada giusta è aspettare. Immaginate uno scenario in cui l’Intelligenza Artificiale raccomanda la dimissione, ma il coniuge del paziente appare timoroso, evidenziando la tensione tra il processo decisionale algoritmico e l’intuizione umana. Tale attrito nel mondo reale sottolinea la posta in gioco dell’ambiguità.

I sistemi di Intelligenza Artificiale non sperimentano incertezza; generano output. Quando sono errati, spesso lo fanno con una sicurezza ingiustificata. Questa caratteristica non è un difetto di programmazione, ma una caratteristica intrinseca della modellazione statistica. A differenza dei medici esperti che esprimono apertamente dubbi, i modelli linguistici di grandi dimensioni e i sistemi di apprendimento automatico non sono in grado di riconoscere i propri limiti. Producono risposte plausibili anche quando i dati sono insufficienti. In medicina, la plausibilità senza fondamento può essere rischiosa.

Man mano che questi sistemi vengono integrati tempestivamente nei flussi di lavoro clinici, i loro risultati influenzano sempre di più le decisioni successive. Col tempo, i medici potrebbero iniziare a fidarsi delle raccomandazioni non per la loro validità, ma perché sono diventate standardizzate. Il giudizio si sposta gradualmente dal ragionamento attivo all’accettazione passiva. In tali circostanze, la presenza umana nel ciclo funge da mero strumento di salvaguardia simbolica.

Iscriviti alla Newslettera di Renovatio 21

I sostenitori affermano spesso che l’IA si limiterà a «migliorare» i medici, piuttosto che sostituirli. Tuttavia, questa rassicurazione è labile. Una volta che l’IA dimostra guadagni in termini di efficienza, le pressioni economiche e istituzionali tendono a favorire una maggiore autonomia. Se un sistema può rinnovare le prescrizioni in modo sicuro, potrebbe presto essere autorizzato a iniziarle. Se riesce a diagnosticare accuratamente patologie comuni, la necessità della revisione medica viene messa in discussione. Se supera gli esseri umani in benchmark controllati, la tolleranza alla variabilità umana diminuisce.

Alla luce di queste tendenze, è essenziale implementare misure di salvaguardia specifiche. Ad esempio, audit obbligatori sulle discrepanze sul 5% delle decisioni basate sull’Intelligenza Artificiale potrebbero fungere da controllo concreto, garantendo l’allineamento tra le raccomandazioni dell’Intelligenza Artificiale e il giudizio clinico umano, fornendo al contempo alle autorità di regolamentazione e ai consigli di amministrazione ospedalieri metriche concrete per monitorare l’integrazione dell’Intelligenza Artificiale.

Queste domande non sono poste con cattive intenzioni; emergono naturalmente all’interno di sistemi focalizzati sul contenimento dei costi e sulla scalabilità. Tuttavia, indicano un futuro in cui il giudizio umano diventerà l’eccezione piuttosto che la norma. In un simile scenario, gli individui con risorse continueranno a ricevere cure umane, mentre altri saranno indirizzati attraverso processi automatizzati. La medicina a due livelli non sarà il risultato di un’ideologia, ma di un’ottimizzazione.

Ciò che rende questo momento particolarmente precario è l’assenza di chiare linee di responsabilità. Quando una decisione guidata dall’Intelligenza Artificiale danneggia un paziente, chi è responsabile? È il medico che supervisiona nominalmente il sistema? L’istituzione che lo ha implementato? Il fornitore che ha addestrato il modello? L’ente regolatore che ne ha approvato l’uso? Senza risposte esplicite, la responsabilità svanisce. E quando la responsabilità svanisce, la fiducia segue a ruota.

La medicina si basa fondamentalmente sulla fiducia. I pazienti affidano il loro corpo, le loro paure e spesso le loro vite nelle mani dei medici. Questa fiducia non può essere trasferita a un algoritmo, per quanto sofisticato possa essere. Si basa sulla certezza della presenza di un essere umano, qualcuno capace di ascoltare, adattarsi e assumersi la responsabilità delle proprie azioni.

Rifiutare del tutto l’Intelligenza Artificiale è superfluo. Se utilizzata con giudizio, l’IA può ridurre gli oneri amministrativi, identificare modelli che potrebbero sfuggire al rilevamento umano e supportare il processo decisionale clinico. Può consentire ai medici di dedicare più tempo all’assistenza ai pazienti piuttosto che alle attività amministrative. Tuttavia, realizzare questo futuro richiede un chiaro impegno a mantenere la responsabilità umana al centro della pratica medica.

«Human-in-the-loop» deve significare più di una supervisione simbolica. Dovrebbe richiedere che un individuo specifico sia responsabile di ogni decisione medica, ne comprenda le motivazioni e mantenga sia l’autorità che l’obbligo di ignorare le raccomandazioni algoritmiche. Deve inoltre implicare trasparenza, spiegabilità e consenso informato del paziente, nonché l’impegno a investire nei medici umani anziché sostituirli con l’Intelligenza Artificiale.

Iscriviti al canale Telegram ![]()

Il rischio principale non è l’eccessivo potere dell’Intelligenza Artificiale, ma piuttosto la volontà delle istituzioni di rinunciare alle proprie responsabilità. Nella ricerca di efficienza e innovazione, c’è il rischio che la medicina diventi un campo tecnicamente avanzato e amministrativamente snello, ma privo di sostanza morale.

Mentre pensiamo al futuro, è essenziale chiedersi: che tipo di guaritore immaginiamo al capezzale del paziente nel 2035? Questa domanda richiede un’immaginazione morale collettiva, incoraggiandoci a plasmare un futuro in cui la responsabilità umana e l’assistenza compassionevole rimangano al centro della pratica medica. Mobilitare l’azione collettiva sarà fondamentale per garantire che i progressi nell’Intelligenza Artificiale migliorino, anziché indebolire, questi valori fondamentali.

L’Intelligenza Artificiale non è autorizzata a esercitare la professione medica. Ma la medicina viene silenziosamente riprogettata attorno a sistemi privi di peso morale. Se questo processo continua senza controllo, un giorno potremmo scoprire che il medico non è stato sostituito da una macchina, ma da un protocollo, e che quando si verifica un danno, non c’è più nessuno che possa risponderne.

Questo non sarebbe un progresso. Sarebbe un’abdicazione.

Joseph Varon

Joseph Varon, MD, è medico di terapia intensiva, professore e presidente dell’Independent Medical Alliance. È autore di oltre 980 pubblicazioni peer-reviewed ed è caporedattore del Journal of Independent Medicine.

Iscriviti alla Newslettera di Renovatio 21

-

Autismo2 settimane fa

Autismo2 settimane faEcco la Barbie autistica: il mondo verso la catastrofe sanitaria (e il Regno Sociale di Satana)

-

Immigrazione2 settimane fa

Immigrazione2 settimane faLe nostre città ridisegnate dagli immigrati

-

Spirito2 settimane fa

Spirito2 settimane fa«Sinodalità e vigile attesa»: mons. Viganò sul mito del Concilio Vaticano II «sicuro ed efficace»

-

Armi biologiche6 giorni fa

Armi biologiche6 giorni faI vaccini COVID mirano a ridurre la popolazione mondiale avvelenando miliardi di persone: parla un medico sudafricano

-

Gender2 settimane fa

Gender2 settimane faIl giornale dei vescovi italiani difende la transessualità nei bambini

-

Geopolitica7 giorni fa

Geopolitica7 giorni fa«L’ordine basato sulle regole» non era reale: ora siamo nell’era della fantasia geopolitica imperiale. Cosa accadrà al mondo e all’Italia?

-

Salute1 settimana fa

Salute1 settimana faI malori della 3ª settimana 2026

-

Pensiero1 settimana fa

Pensiero1 settimana faIl discorso di Trump a Davos