Intelligenza Artificiale

La lettera di Elon Musk per fermare l’Intelligenza Artificiale

Elon Musk, il cofondatore di Apple e molti esperti informatici tra cui i professori di AI Yoshua Bengio e Stuart Russel altro hanno firmato una lettera pubblicata dal Future of Life Institute per fermare l’avanzata dell’Intelligenza Artificiale, arrivata a spaventare anche l’opinione pubblica con chatGPT, software di cui si è impadronita spendendo 10 miliardi la Microsoft di Bill Gates.

Come riportato da Renovatio 21, il software è arrivato a minacciare gli utenti, fare proclami stralunati, perfino dichiarare di voler sterminare gli esseri umani, e creare codice per prendere il controllo del computer dei suoi interlocutori.

L’appello di Musk e compagni (tra i quali, purtroppo, vediamo anche Yuval Harari) è paragonabile a quelli che decenni fa si sono visti per lo sviluppo delle armi atomiche, e – aggiungiamo noi – che non si sono visti per le armi biologiche e le ricerche Gain of Function: il risultato del genio scappato dalla lampada lì è stato, con estrema probabilità, la catastrofe della pandemia COVID-19.

Gli effetti della fuga del genio AI dalla lampada, strofinata a dovere da oligarchi senza scrupoli e senza amore per il genere umano, non riusciamo ancora ad immaginarceli.

Tuttavia Elon Musk, oramai quasi una decina di anni fa, ci aveva messo in guardia: sarà «come evocare un demone».

È il momento di avere paura. È il momento di agire – è il momento che se ne occupi la politica, che in Italia invece che vedere il precipizio davanti alla popolazione, come sempre, si occupa di quisquilie e problemucci partitici, sempre obbediente ai suoi capi di Bruxelles, Francoforte, Washington, e quindi incapace di difenderci davvero.

La minaccia è reale, e Renovatio 21 ve lo ripete da anni.

Sotto la traduzione integrale della lettera.

«Mettete in pausa gli esperimenti di Intelligenza Artificiale gigante: una lettera aperta»

Chiediamo a tutti i laboratori di Intelligenza Artificiale di sospendere immediatamente per almeno 6 mesi l’addestramento di sistemi di Intelligenza Artificiale più potenti di GPT-4.

I sistemi di Intelligenza Artificiale con intelligenza competitiva umana possono comportare gravi rischi per la società e l’umanità, come dimostrato da ricerche approfondite (1) e riconosciuto dai migliori laboratori di Intelligenza Artificiale. (1)

Come affermato nei Principi Asilomar AI ampiamente approvati, l’IA avanzata potrebbe rappresentare un profondo cambiamento nella storia della vita sulla Terra e dovrebbe essere pianificata e gestita con cure e risorse adeguate.

Sfortunatamente, questo livello di pianificazione e gestione non sta accadendo, anche se negli ultimi mesi i laboratori di Intelligenza Artificiale sono stati incastrati in una corsa fuori controllo per sviluppare e implementare menti digitali sempre più potenti che nessuno, nemmeno i loro creatori, può capire, prevedere o controllare in modo affidabile.

I sistemi di Intelligenza Artificiale contemporanei stanno ora diventando competitivi per l’uomo in compiti generali, (3) e dobbiamo chiederci: dovremmo lasciare che le macchine inondino i nostri canali di informazioni con propaganda e falsità?

Dovremmo automatizzare tutti i lavori, compresi quelli soddisfacenti?

Dovremmo sviluppare menti non umane che alla fine potrebbero essere più numerose, superate in astuzia, obsolete e sostituirci?

Dovremmo rischiare di perdere il controllo della nostra civiltà?

Tali decisioni non devono essere delegate a leader tecnologici non eletti. Potenti sistemi di Intelligenza Artificiale dovrebbero essere sviluppati solo quando saremo certi che i loro effetti saranno positivi e i loro rischi saranno gestibili.

Questa fiducia deve essere ben giustificata e aumentare con l’entità degli effetti potenziali di un sistema. La recente dichiarazione di OpenAI sull’Intelligenza Artificiale generale afferma che «ad un certo punto, potrebbe essere importante ottenere una revisione indipendente prima di iniziare ad addestrare i sistemi futuri e, per gli sforzi più avanzati, concordare di limitare il tasso di crescita del calcolo utilizzato per creare nuovi Modelli». Siamo d’accordo. Quel punto è adesso.

Pertanto, invitiamo tutti i laboratori di Intelligenza Artificiale a sospendere immediatamente per almeno 6 mesi l’addestramento di sistemi di Intelligenza Artificiale più potenti di GPT-4. Questa pausa dovrebbe essere pubblica e verificabile e includere tutti gli attori chiave. Se una tale pausa non può essere attuata rapidamente, i governi dovrebbero intervenire e istituire una moratoria.

I laboratori di Intelligenza Artificiale e gli esperti indipendenti dovrebbero sfruttare questa pausa per sviluppare e implementare congiuntamente una serie di protocolli di sicurezza condivisi per la progettazione e lo sviluppo avanzati di Intelligenza Artificiale, rigorosamente verificati e supervisionati da esperti esterni indipendenti. Questi protocolli dovrebbero garantire che i sistemi che vi aderiscono siano sicuri oltre ogni ragionevole dubbio. (4)

Ciò non significa una pausa nello sviluppo dell’IA in generale, ma semplicemente un passo indietro dalla pericolosa corsa a modelli black-box sempre più grandi e imprevedibili con capacità emergenti.

La ricerca e lo sviluppo dell’IA dovrebbero essere riorientati per rendere i sistemi potenti e all’avanguardia di oggi più accurati, sicuri, interpretabili, trasparenti, robusti, allineati, affidabili e leali.

Parallelamente, gli sviluppatori di Intelligenza Artificiale devono collaborare con i responsabili politici per accelerare drasticamente lo sviluppo di solidi sistemi di governance dell’IA.

Questi dovrebbero come minimo includere: autorità di regolamentazione nuove e capaci dedicate all’IA; supervisione e tracciamento di sistemi di Intelligenza Artificiale altamente capaci e ampi pool di capacità computazionali; sistemi di provenienza e watermarking per aiutare a distinguere il reale dal sintetico e per tenere traccia delle fughe di modelli; un solido ecosistema di audit e certificazione; responsabilità per danni causati dall’IA; solidi finanziamenti pubblici per la ricerca tecnica sulla sicurezza dell’IA; e istituzioni dotate di risorse adeguate per far fronte alle drammatiche perturbazioni economiche e politiche (soprattutto per la democrazia) che l’IA causerà.

L’umanità può godere di un futuro fiorente con l’IA. Dopo essere riusciti a creare potenti sistemi di Intelligenza Artificiale, ora possiamo goderci un’«estate di Intelligenza Artificiale» in cui raccogliamo i frutti, progettiamo questi sistemi per il chiaro vantaggio di tutti e diamo alla società la possibilità di adattarsi. La società ha messo in pausa altre tecnologie con effetti potenzialmente catastrofici sulla società. (5)

Possiamo farlo qui. Godiamoci una lunga estate AI, non precipitiamoci impreparati nell’autunno.

NOTE

1) Bender, E. M., Gebru, T., McMillan-Major, A., & Shmitchell, S. (2021, March). On the Dangers of Stochastic Parrots: Can Language Models Be Too Big?????. In Proceedings of the 2021 ACM conference on fairness, accountability, and transparency (pp. 610-623).

Bostrom, N. (2016). Superintelligence. Oxford University Press.

Bucknall, B. S., & Dori-Hacohen, S. (2022, July). Current and near-term AI as a potential existential risk factor. In Proceedings of the 2022 AAAI/ACM Conference on AI, Ethics, and Society (pp. 119-129).

Carlsmith, J. (2022). Is Power-Seeking AI an Existential Risk?. arXiv preprint arXiv:2206.13353.

Christian, B. (2020). The Alignment Problem: Machine Learning and human values. Norton & Company.

Cohen, M. et al. (2022). Advanced Artificial Agents Intervene in the Provision of Reward. AI Magazine, 43(3) (pp. 282-293).

Eloundou, T., et al. (2023). GPTs are GPTs: An Early Look at the Labor Market Impact Potential of Large Language Models.

Hendrycks, D., & Mazeika, M. (2022). X-risk Analysis for AI Research. arXiv preprint arXiv:2206.05862.

Ngo, R. (2022). The alignment problem from a deep learning perspective. arXiv preprint arXiv:2209.00626.

Russell, S. (2019). Human Compatible: Artificial Intelligence and the Problem of Control. Viking.

Tegmark, M. (2017). Life 3.0: Being Human in the Age of Artificial Intelligence. Knopf.

Weidinger, L. et al (2021). Ethical and social risks of harm from language models. arXiv preprint arXiv:2112.04359.

2) Ordonez, V. et al. (2023, March 16). OpenAI CEO Sam Altman says AI will reshape society, acknowledges risks: ‘A little bit scared of this’. ABC News.

Perrigo, B. (2023, January 12). DeepMind CEO Demis Hassabis Urges Caution on AI. Time.

3) Bubeck, S. et al. (2023). Sparks of Artificial General Intelligence: Early experiments with GPT-4. arXiv:2303.12712.

OpenAI (2023). GPT-4 Technical Report. arXiv:2303.08774.

4) Esiste un ampio precedente legale: ad esempio, i principi IA dell’OCSE ampiamente adottati richiedono che i sistemi IA «funzionino in modo appropriato e non comportino un rischio irragionevole per la sicurezza».

5) Gli esempi includono la clonazione umana, la modifica della linea germinale umana, la ricerca sul guadagno di funzione e l’eugenetica.

Intelligenza Artificiale

Il Pentagono stringe accordi con le principali aziende di Intelligenza Artificiale

Il Pentagono ha dichiarato di aver raggiunto accordi con importanti aziende specializzate in intelligenza artificiale per integrare le loro funzionalità avanzate di IA nelle reti classificate dell’agenzia.

Il dipartimento della Guerra degli Stati Uniti ha avviato trattative attive con i leader del settore dall’inizio dell’anno, nel tentativo di ampliare l’applicazione dell’intelligenza artificiale nelle operazioni militari e diversificare la gamma di aziende che forniscono questa tecnologia.

Il progetto sta procedendo nonostante le preoccupazioni degli esperti circa la capacità dell’AI di operare in modo affidabile nel rispetto delle leggi di guerra vigenti e il suo possibile utilizzo per violare la privacy dei civili in tempo di pace.

Sono stati raggiunti accordi con SpaceX, OpenAI, Google, NVIDIA, Reflection, Microsoft, Amazon Web Services e Oracle per l’implementazione dei loro sistemi di IA per un «uso operativo lecito», ha dichiarato il Pentagono in un comunicato stampa venerdì.

L’intelligenza artificiale verrà integrata nelle reti Impact Level 6 e Impact Level 7 del Dipartimento della Guerra per «semplificare la sintesi dei dati, migliorare la comprensione della situazione e potenziare il processo decisionale dei militari in ambienti operativi complessi», si legge nella dichiarazione.

Sostieni Renovatio 21

La piattaforma di intelligenza artificiale ufficiale del Dipartimento della Guerra degli Stati Uniti, GenAI.mil, è stata utilizzata da oltre 1,3 milioni di persone negli ultimi cinque mesi, «generando decine di milioni di richieste e impiegando centinaia di migliaia di agenti», ha affermato il Dipartimento. Secondo il Pentagono, la tecnologia ha permesso di accelerare l’esecuzione di determinate attività, riducendo i tempi da mesi a giorni.

Parallelamente, la Marina statunitense ha assegnato alla Domino Data Lab, società di AI con sede a San Francisco, un contratto da 100 milioni di dollari per contribuire alla lotta contro le mine iraniane nello Stretto di Hormuz, di fatto bloccato sin dai primi giorni della guerra tra Stati Uniti e Israele contro l’Iran.

«La Marina sta finanziando la piattaforma che le consente di addestrare, gestire e impiegare l’IA alla velocità necessaria per operare in acque contese», ha dichiarato venerdì a Reuters Thomas Robinson, CEO di Domino. Secondo quanto riportato, Washington punta sulla velocità dell’IA nell’analizzare una grande quantità di dati provenienti da diversi tipi di sensori per migliorare rapidamente il rilevamento delle mine nei droni sottomarini statunitensi.

I recenti accordi del Pentagono con aziende di intelligenza artificiale hanno escluso in modo evidente Anthropic, che all’inizio di quest’anno ha avuto un diverbio con il Pentagono dopo essersi rifiutata di allentare le misure di sicurezza a protezione della sua tecnologia. L’azienda sosteneva che la sua IA potesse essere utilizzata per la sorveglianza interna o per il dispiegamento di armi automatiche senza supervisione umana.

Il dipartimento della Guerra ha reagito classificando Anthropic come «rischio per la catena di approvvigionamento», un’etichetta rara solitamente riservata a entità legate ad avversari stranieri di Washington, escludendo di fatto l’azienda da qualsiasi contratto futuro.

Il segretario alla Guerra statunitense Pete Hegseth ha definito l’amministratore delegato di Anthropic, Dario Amodei, un «pazzo ideologico» durante un’audizione al Senato degli Stati Uniti all’inizio di questa settimana. Hegseth ha paragonato la riluttanza dell’azienda ad accettare le condizioni del Pentagono a «la Boeing che ci dà gli aerei e ci dice chi possiamo colpire».

Attualmente Anthropic ha intentato una causa contro il Pentagono per ottenere la rimozione dell’etichetta di «rischio della catena di approvvigionamento».

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Donna fa causa a OpenAI: ChatGPT le avrebbe scatenato contro uno stalker spietato

Sostieni Renovatio 21

Aiuta Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Google sigla un accordo con il Pentagono sull’Intelligenza Artificiale

Google ha raggiunto un accordo per fornire al Pentagono i suoi modelli di Intelligenza Artificiale destinati a uso secretato. Lo riporta il New York Times.

L’intesa è stata siglata nonostante le proteste interne all’azienda e le persistenti controversie sulle applicazioni militari della tecnologia. A partire dallo scorso anno, il Pentagono ha rapidamente ottenuto l’accesso all’intelligenza artificiale avanzata tramite accordi analoghi con i principali sviluppatori del settore.

Secondo le informazioni diffuse, l’accordo amplia un contratto da 200 milioni di dollari firmato nel 2025, che consente all’IA Gemini di Google di funzionare su reti classificate. Il colosso tecnologico ha confermato l’intesa, senza però fornire ulteriori dettagli.

«Siamo orgogliosi di far parte di un ampio consorzio… che fornisce servizi di AI a supporto della sicurezza nazionale», ha dichiarato la portavoce dell’azienda, Jenn Crider, aggiungendo che Google resta impegnata a garantire che l’IA non venga utilizzata per la sorveglianza di massa interna o per armi autonome senza supervisione umana.

Secondo quanto riportato per primo dalla testata della Silicon Valley The Information, il Pentagono potrà ora impiegare l’intelligenza artificiale di Google per «qualsiasi scopo governativo lecito», termini che ricalcano gli accordi stipulati con altri sviluppatori di IA.

Funzionari statunitensi sostengono che il nuovo contratto mira a garantire alle forze armate maggiore flessibilità ed evitare la dipendenza da un unico fornitore, integrando l’IA in operazioni sensibili come la pianificazione delle missioni e il puntamento delle armi. Tuttavia, l’accordo consentirebbe al Pentagono di richiedere modifiche ai filtri di sicurezza di Google, pur specificando che l’azienda non può porre il veto a decisioni «legittime per il governo», clausola che ha destato preoccupazione tra i critici.

Sostieni Renovatio 21

L’intesa ha scatenato polemiche interne a Google. In una lettera aperta pubblicata questa settimana, oltre 600 dipendenti, tra cui dirigenti di alto livello, hanno esortato l’amministratore delegato Sundar Pichai a interrompere l’utilizzo dell’AI dell’azienda in ambito militare, avvertendo che potrebbe essere impiegata in «modi disumani o estremamente dannosi». Hanno chiesto una moratoria su tali contratti, maggiore trasparenza e la creazione di un comitato etico per supervisionare le collaborazioni con le forze armate.

L’accordo arriva dopo la controversia tra il Pentagono e la startup Anthropic, che all’inizio di quest’anno si era rifiutata di allentare le misure di sicurezza relative alla sorveglianza e alle armi autonome. Il dipartimento della Difesa l’aveva definita un «rischio per la catena di approvvigionamento», escludendola di fatto da futuri contratti. Da allora Anthropic ha impugnato la decisione in tribunale.

Altre aziende hanno scelto un approccio diverso. OpenAI ha recentemente concluso un accordo per implementare i suoi modelli su reti classificate del Pentagono, mentre xAI di Musk ha integrato i suoi sistemi nella piattaforma interna di IA delle forze armate, GenAI.mil, utilizzata da milioni di persone.

La spinta del Pentagono verso l’IA ha provocato proteste da parte di lavoratori del settore tecnologico e attivisti, che mettono in guardia contro l’impiego della tecnologia in ambito militare senza adeguati controlli. Il mese scorso manifestanti si sono radunati davanti agli uffici di OpenAI con slogan come «No allo stato di sorveglianza basato sull’IA» e «Orwell ci aveva avvertito».

Il Pentagono ribadisce di non avere intenzione di utilizzare l’AI per la sorveglianza di massa sul territorio nazionale o per armi completamente autonome, ma continua a promuovere un ampio accesso ai sistemi avanzati per «qualsiasi uso lecito».

Iscriviti alla Newslettera di Renovatio 21

-

Spirito2 settimane fa

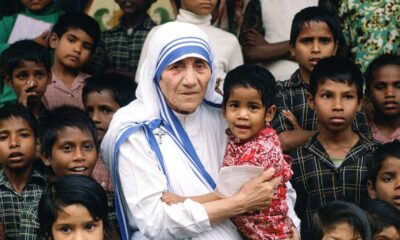

Spirito2 settimane faMadre Teresa disse a un sacerdote: la Comunione sulla mano era «il peggior male» mai visto

-

Pensiero2 settimane fa

Pensiero2 settimane faIl manifesto di Palantir in sintesi

-

Misteri2 settimane fa

Misteri2 settimane faEsperto di UFO trovato morto suicida. Aveva ripetuto che mai lo avrebbe fatto

-

Spirito1 settimana fa

Spirito1 settimana faLeone e l’arcivescovessa, mons. Viganò: Roma sta con gli eretici e nega le cresime ai tradizionisti

-

Misteri1 settimana fa

Misteri1 settimana faRitrovata l’Arca di Noè?

-

Bioetica5 giorni fa

Bioetica5 giorni faCorpi senza testa per produrre organi: l’uomo ridotto a funzione, la medicina contro l’anima

-

Salute2 settimane fa

Salute2 settimane faI malori della 17ª settimana 2026

-

Spirito1 settimana fa

Spirito1 settimana faMons Strickland risponde alle osservazioni di papa Leone sulle «benedizioni» omosessuali