Intelligenza Artificiale

Intelligenza Artificiale, in realtà i poveri nei Paesi in via di sviluppo svolgono il lavoro

Le aziende di Intelligenza Artificiale della Silicon Valley farebbero affidamento su manodopera a basso costo all’estero e affidano loro il lavoro necessario per farle funzionare e il più delle volte, i salari e le condizioni di lavoro, sono scadenti. Lo riporta il Washington Post.

Quantità massive di persone nelle Filippine hanno il compito di etichettare le immagini, consentendo agli algoritmi di Intelligenza Artificiale di dare un senso al mondo. A volte viene chiesto loro di dare un senso a blocchi di testo per assicurarsi che i chatbot IA, come ChatGPT di OpenAI, non finiscano per dire sciocchezze.

Molti di questi lavoratori vengono sfruttati e sottopagati, scrive il WaPo. Si tratta di un aspetto assai trascurato, poiché i dibattiti si sono concentrati su questioni più ambigue di potenziali pregiudizi o sulla possibilità che l’IA diventi un pericolo per l’utente finale.

Secondo il rapporto, la startup Scale AI, con sede a San Francisco, impiega almeno 10.000 persone nelle Filippine su una piattaforma chiamata Remotasks. Secondo i dati e le interviste ottenute dal WaPo, la società spesso non è riuscita a pagare in tempo i suoi salariati, anche se un portavoce di Scale AI ha detto a WaPo che «ritardi o interruzioni nei pagamenti sono estremamente rari».

Sostieni Renovatio 21

Un certo numero di freelance di Remotasks hanno dichiarato al giornale di essere stati rigidi nei pagamenti o di non aver mai ricevuto il denaro inizialmente promesso. Un lavoratore di 26 anni ha trascorso tre giorni su un progetto, sperando di ottenere 50 dollari, mentre all’atto pratico ha ricevuto solo 12 dollari.

Dominic Ligot, esperto filippino di etica dell’IA, ha definito questi nuovi luoghi di lavoro che ospitano lavoratori che etichettano filmati o testi per aziende di Intelligenza artificiale come Scale AI, dei «fabbriche di sfruttamento digitali». Inoltre, i lavoratori non avrebbero mezzi efficaci per lamentarsi e possono semplicemente essere «disattivati» in caso di lamentele o proteste.

Tutto ciò non sono solo le Filippine. Freelance o «Tasker» sono impiegati anche in Venezuela e in India, innescando una «corsa al ribasso», come dichiarato dal proprietario di un’azienda di outsourcing proprio al giornale statunitense.

L’Intelligenza Artificiale smuove miliardi di dollari negli Stati Uniti, ma coloro che effettivamente svolgono il peso maggiore del lavoro spesso passano inosservati, sottopagati o ignorati del tutto. Forse un chiaro dibattito sull’etica del lavoro riguardo questa nuova tecnologia potrebbe essere fatto.

Come riportato da Renovatio 21, l’esistenza di forza lavoro digitale nel Terzo Mondo era emersa quando una foto di una signora seduta sul water scattata da un aspirapolvere automatico Roomba è finita per qualche ragione su internet. Anche in quel caso, l’immagine era stata gestita da Scale AI, per poi comparire su Facebook e su Discord in gruppi di lavoratori digitali venezuelani nel 2020.

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Esperti di AI mettono in guardia dai pericoli del «comportamento strategico emergente».

Iscriviti al canale Telegram ![]()

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Scienziato crea un vaccino mRNA per il suo cane usando l’AI

Uno scienziato informatico australiano ha impiegato ChatGPT e Grok per sviluppare una potenziale cura per la sua cagnolina, alla quale era stato diagnosticato un tumore in fase acuta.

Due anni fa, a Rosie, la cagnolina meticcia di Staffordshire Bull Terrier e Shar Pei di Paul Conyngham, è stata diagnosticata una forma aggressiva di mastocitoma, una patologia che colpisce i cani. La chirurgia veterinaria e la chemioterapia hanno rallentato la progressione dei tumori, ma non sono riuscite a ridurne le dimensioni.

Il Conyngham, ingegnere elettrico e informatico nonché cofondatore di Core Intelligence Technologies, si è rivolto a ChatGPT per elaborare possibili trattamenti, prima di sfruttare la sua esperienza nell’analisi dei dati per identificare le mutazioni nel tumore, mappare le proteine alterate mediante AlphaFold e abbinare i potenziali bersagli ai farmaci.

«Il primo passo è stato contattare l’università per far sequenziare il DNA di Rosie. L’idea è di prelevare il DNA sano dal suo sangue e poi il DNA dal suo tumore e sequenziarli entrambi per vedere esattamente dove si sono verificate le mutazioni», ha detto all’Australian.

Iscriviti alla Newslettera di Renovatio 21

I ricercatori del Ramaciotti Centre for Genomics dell’UNSW hanno collaborato al sequenziamento del DNA di Rosie, mentre gli scienziati hanno utilizzato il modello di mRNA elaborato da Conyngham per sintetizzare la nanoparticella del vaccino. Il trattamento è stato somministrato dalla veterinaria oncologa professoressa Rachel Allavena dell’Università del Queensland, che ha supervisionato la terapia sperimentale.

Rosie ha ricevuto la prima iniezione a dicembre, seguita da una dose di richiamo il mese successivo. Nonostante il tumore fosse in stadio avanzato, le condizioni della cagnolina sono migliorate nel giro di poche settimane dall’inizio del trattamento, con una massa tumorale che si è ridotta di quasi la metà. A quanto pare, Rosie ora appare più sana e piena di energia.

Gli scienziati stanno ora sequenziando nuovamente il tumore per progettare un secondo vaccino mirato alle cellule cancerose che non hanno risposto al primo trattamento.

L’inquietante episodio mostra come siano in fase di sviluppo vaccini oncologici personalizzati a mRNA, anche per uso umano.

Come riportato da Renovatio 21, l’intreccio tra AI e sieri genici personalizzati era stata oscuramente annunziato dal miliardario informatico sionista Larry Ellison durante un incontro alla Casa Bianca nelle primissime ore della seconda presidenza Trump che proclamava l’avvio del progetto per lo sviluppo dell’IA detto «Stargate».

«Una delle cose più entusiasmanti su cui stiamo lavorando utilizzando gli strumenti forniti da Sam [Altman] e [Masayoshi Son] è un vaccino contro il cancro», aveva affermato l’Ellison con a fianco il presidente Trump. «A quanto pare, tutti i nostri tumori, i tumori cancerosi, piccoli frammenti di quei tumori fluttuano nel sangue. Quindi puoi fare una diagnosi precoce del cancro con un esame del sangue. E usando l’intelligenza artificiale per guardare l’esame del sangue, puoi trovare i tumori che in realtà minacciano seriamente la persona».

Aiuta Renovatio 21

«La diagnosi del cancro tramite Intelligenza Artificiale promette di essere semplicemente un esame del sangue», aveva continuato Ellison. «Quindi, una volta che abbiamo sequenziato il gene di quel tumore canceroso, puoi vaccinare la persona, progettare un vaccino per ogni singola persona per vaccinarla contro quel cancro».

«E puoi realizzare quel vaccino mRNA, puoi realizzarlo roboticamente con l’uso dell’IA in circa 48 ore», ha aggiunto l’ultramiliardario, da anni stabilmente nella top ten dei più ricchi del pianeta. «Questa è la promessa dell’IA e la promessa del futuro».

Come sottolineato negli anni da Renovatio 21, se non sarà posto un limite, ogni vaccino, in realtà ogni «cura» dell’organismo umano e non, passerà per la genetica, con sieri DNA, RNA, mRNA, microRNA, circRNA, etc.

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Soldati umanoidi testati in Ucraina

Iscriviti al canale Telegram ![]()

Aiuta Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

-

Bioetica2 settimane fa

Bioetica2 settimane faCirconcisione, scoppia l’incidente diplomatico: il Belgio convoca l’ambasciatore americano

-

Morte cerebrale2 settimane fa

Morte cerebrale2 settimane faIl bambino con il cuore «bruciato» e la tremenda verità sui numeri dei trapianti falliti

-

Spirito4 giorni fa

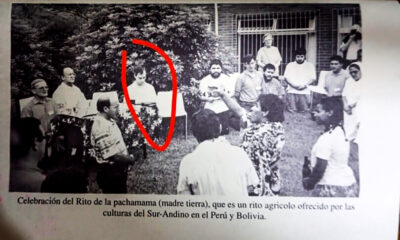

Spirito4 giorni faFoto del 1995 mostra Leone XIV mentre partecipa al rituale idolatrico della Pachamama

-

Vaccini2 settimane fa

Vaccini2 settimane faEsperti affrontano la questione della «massiccia epidemia di danni da vaccino»

-

Pensiero1 settimana fa

Pensiero1 settimana faVerso la legge che fa dell’antisemitismo una nuova categoria dello spirito

-

Senza categoria1 settimana fa

Senza categoria1 settimana faMons. Viganò sta con la famiglia nel bosco. Ma perché lo Stato si sta accanendo in questo modo?

-

Eugenetica2 settimane fa

Eugenetica2 settimane fa«Organi e sperma prelevati dai corpi» nel ranch di Epstein

-

Immigrazione2 settimane fa

Immigrazione2 settimane faIl cardinale Zuppi va all’evento del Ramadan. Poi si preoccupa per le zero iscrizioni al catechismo e la mancanza di famiglie cattoliche