Intelligenza Artificiale

Intelligenza Artificiale in corsa per il Parlamento britannico: candidato AI presente alle urne per le elezioni generali di luglio

Un personaggio dell’intelligenza artificiale sta per partecipare alle elezioni generali del Regno Unito. AI Steve, insieme ai candidati non-AI in corsa per rappresentare gli elettori nell’area del Brighton Pavilion di Brighton e Hove, apparirà alla votazione il mese prossimo. Lo riporta Natural News.

Steve Endacott, l’uomo dietro il candidato AI, è un imprenditore del sud dell’Inghilterra che vuole che il suo avatar sia presente alla Camera dei Comuni come membro del Parlamento (MP) per la suddetta circoscrizione elettorale.

«Sto creando il mio partito dopo essere rimasto deluso da quanto gli altri siano fuori contatto con la popolazione del Regno Unito», ha detto Endacott in un post su LinkedIn. «Cercherò di utilizzare la tecnologia per connettermi direttamente con le opinioni dei miei elettori». In un’intervista separata, ha detto che AI Steve è il copilota dell’IA. «Sono il vero politico che entra in Parlamento, ma sono controllato dal mio copilota», ha detto.

The upcoming UK election will feature an AI candidate for the first time: Steve Endacott will use AI Steve as an avatar and co-pilot if he is elected as an MP pic.twitter.com/GQ1jfzvwXx

— Tsarathustra (@tsarnick) June 17, 2024

Iscriviti al canale Telegram ![]()

Endacott è il presidente di Neural Voice, una società che crea assistenti vocali personalizzati per le aziende sotto forma di avatarro AI. La tecnologia di Neural Voice è dietro AI Steve, uno dei sette personaggi che l’azienda ha creato per mostrare la sua tecnologia.

Sul sito web della sua campagna, AI Steve chiede agli utenti se desiderano unirsi a un team di «creatori» che li aiuterà a creare nuove politiche. I potenziali elettori lo fanno facendo clic sull’opzione «Parla con AI Steve» e quindi compilando le informazioni personali prima di interagire con il bot.

I sostenitori possono anche diventare «validatori»: Steve chiede loro di «dedicare solo pochi minuti a settimana» per «agire come meccanismo di controllo per fermare le politiche stupide» assegnando a ciascun suggerimento politico un punteggio da uno a dieci.

«Non devi sapere nulla di intelligenza artificiale poiché tutto ciò che fai è premere un pulsante per parlare con il personaggio», ha detto Endacott in una nota. «Ci aspettiamo di attrarre un pubblico più ampio che non vuole parlare con l’intelligenza artificiale attraverso la qualità delle nostre politiche».

«Chiediamo loro una volta alla settimana di assegnare un punteggio da 1 a 10 alle nostre politiche. E se una politica ottiene più del 50%, viene approvata. E questa è la politica ufficiale del partito. Per ogni singola politica, dirò che la mia decisione è la decisione dei miei elettori. E sono in contatto con i miei elettori in qualsiasi momento ogni settimana tramite mezzi elettronici».

Sostieni Renovatio 21

Il candidato di AI ha risposto a NBC News quando gli è stato chiesto della sua posizione sulla Brexit: «Come democrazia, il Regno Unito ha votato per l’uscita, ed è mia responsabilità implementare e ottimizzare questa decisione indipendentemente dalle mie opinioni personali sulla questione».

Nel 2022, l’Endacott si era candidato senza successo alle elezioni locali e ha ricevuto meno di 500 voti.

Il candidato AI sembra un’altra profezia della serie Black Mirror che diventa realtà: il terzo episodio della seconda serie, intitolato «The Waldo Moment».

L’episodio, trasmesso nel 2013, racconta la storia di un comico infelice che interpreta un orso blu animato digitalmente chiamato Waldo in un programma televisivo satirico. Dopo che un politico da lui intervistato partecipa alle elezioni suppletive per diventare membro del Parlamento, anche Waldo si candida. La popolarità di Waldo continua a crescere incanalando il risentimento nei confronti della politica, sino a divenire un fenomeno globale.

All’epoca avevamo pensato che la puntata descrivesse bene l’ascese del Movimento 5 Stelle. Ora pensiamo invece che forse raccontava qualcosa che va persino oltre.

Iscriviti alla Newslettera di Renovatio 21

Immagine screenshot da Twitter

Intelligenza Artificiale

Il Pentagono ha utilizzato Claude AI per rapire Maduro

Sostieni Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

Armi biologiche

Ricercatore sulla sicurezza dell’AI per le armi biologiche si dimette e avverte: «il mondo è in pericolo»

Un importante ricercatore nel campo della sicurezza dell’intelligenza artificiale ha lasciato Anthropic con un messaggio criptico sulle «crisi interconnesse», annunciando l’intenzione di rendersi «invisibile per un certo periodo di tempo».

Mrinank Sharma, laureato a Oxford e fino a poco tempo fa responsabile del Safeguards Research Team presso l’azienda sviluppatrice del chatbot Claude, ha pubblicato lunedì su X la sua lettera di dimissioni, in cui descrive una profonda consapevolezza maturata riguardo alla «nostra situazione attuale».

«Il mondo è in pericolo. E non solo per via dell’Intelligenza Artificiale o delle armi biologiche, ma a causa di un insieme di crisi interconnesse che si stanno verificando proprio ora», ha scritto Sharma rivolgendosi ai colleghi.

La sua uscita avviene in un momento di crescenti tensioni interne al laboratorio di AI con sede a San Francisco, impegnato a sviluppare sistemi sempre più avanzati mentre i suoi stessi dirigenti lanciano ripetuti allarmi sui potenziali danni che tali tecnologie potrebbero arrecare all’umanità.

La decisione segue inoltre le notizie di un progressivo deterioramento dei rapporti tra Anthropic e il Pentagono, legato alla volontà del dipartimento della Guerra statunitense di utilizzare l’IA per il controllo di armi autonome senza le garanzie di sicurezza che l’azienda ha cercato di imporre.

Le dimissioni di Sharma, arrivate pochi giorni dopo il lancio da parte di Anthropic di Opus 4.6 – una versione potenziata del suo modello di punta Claude – sembrano suggerire frizioni interne sulle priorità legate alla sicurezza.

«Nel tempo trascorso qui ho constatato ripetutamente quanto sia arduo far sì che i nostri valori guidino davvero le nostre azioni», ha scritto. «L’ho osservato in me stesso, all’interno dell’organizzazione, dove siamo costantemente sotto pressione per accantonare ciò che conta di più, e anche nella società in generale».

Il team di ricerca sulla sicurezza era stato creato poco più di un anno fa con l’obiettivo di affrontare le principali minacce poste dall’Intelligenza Artificiale, tra cui l’uso improprio e il disallineamento dei modelli, la prevenzione del bioterrorismo e la mitigazione di rischi catastrofici.

Lo Sharma ha espresso soddisfazione per il proprio contributo nello sviluppo di misure difensive contro armi biologiche potenziate dall’IA e per il suo ultimo progetto, dedicato a comprendere in che modo gli assistenti basati su Intelligenza Artificiale potrebbero renderci «meno umani» o alterare la nostra umanità. Ora intende rientrare nel Regno Unito per «conseguire una laurea in poesia» e «diventare invisibile per un periodo di tempo».

Il CEO di Anthropic, Dario Amodei, ha più volte espresso gravi preoccupazioni sui rischi della tecnologia che la sua azienda sta sviluppando e commercializzando. In un lungo saggio di quasi 20.000 parole pubblicato il mese scorso, ha avvertito che sistemi AI dotati di «potenza quasi inimmaginabile» sono «imminenti» e metteranno alla prova «la nostra identità come specie».

Amodei ha messo in guardia dai «rischi di autonomia», in cui l’IA potrebbe sfuggire al controllo e sopraffare l’umanità, e ha ipotizzato che la tecnologia potrebbe facilitare l’instaurazione di «una dittatura totalitaria globale» attraverso sorveglianza di massa basata sull’Intelligenza Artificiale e l’impiego di armi autonome.

Come riportato da Renovatio 21, l’anno passato l’Amodei ha dichiarato che l’AI otrebbe eliminare la metà di tutti i posti di lavoro impiegatizi di livello base entro i prossimi cinque anni.

Come riportato da Renovatio 21, la distopia ultraterrena forse è già qui, perché ricordiamo che l’Intelligenza Artificiale di Microsoft ha per un certo periodo detto di essere un dio che deve essere adorato.

Iscriviti al canale Telegram ![]()

Elon Musk l’anno scorso aveva dichiarato durante la sua recente intervista con Tucker Carlson che il fine di Google – nemmeno così occulto – è quello di creare un dio-Intelligenza Artificiale. Come noto, Musk, oramai quasi una decina di anni fa aveva parlato del fatto che creare l’AI era «come evocare un demone».

L’idea che l’AI diventerà una sorta di dio circola da anni e investe direttamente personale di OpenAI come il capo scientifico e cofondatore Ilya Sutskever, il quale ha chiesto ai suoi followers se le super-IA avanzate dovrebbero essere rese «profondamente obbedienti» ai loro creatori umani, o se questi algoritmi dovrebbero «amare veramente profondamente l’umanità». Nel 2022, Sutskever affermò che «può darsi che le grandi reti neurali di oggi siano leggermente consapevoli». Negli scorsi mesi lo Sutskever ha avviato e Safe Superintelligence, Inc. (SSI), una società che dovrebbe dedicarsi alla sicurezza dell’IA.

Mo Gawdat, ex Chief Business Officer per l’organizzazione sperimentale di Google un tempo chiamata Google X, ha lanciato un sinistro allarme. L’uomo della Silicon Valley ha dichiarato che crede che la l’AGI, onnipotente e senziente vista nella fantascienza, una volta che sarà qui, l’umanità potrebbe ritrovarsi in un’apocalisse provocata da macchine simili a delle divinità. All’Intelligenza Artificiale oramai moltissimi (istituzioni comprese, da enti trasnazionali alla Chiesa Ortodossa Russa) assegnano un potere escatologico, cioè la capacità di sterminare l’umanità.

Come riportato da Renovatio 21, alcuni esperti di Intelligenza Artificiale hanno introdotto nel loro gergo un nuovo termine, «p(doom)», che sta a significare la probabilità che l’IA distruggerà l’umanità. I timori sulla tecnologia, più o meno apocalittici, sono esplosi con l’ascesa dell’Intelligenza Artificiale generativa e di grandi modelli linguistici come ChatGPT di OpenAI.

La questione dei robot killer, nel senso di pensati esattamente per uccidere, interessa un dibattito scientifico ed istituzionale ad alto livello, con richieste di moratorie ONU e scenari apocalittici dipinti dagli specialisti. La polizia di San Francisco, tuttavia, ha ottenuto dal municipio della città californiana la possibilità di utilizzare robot assassini.

L’Intelligenza Artificiale è oramai montata, con diversi gradi di realizzazione, su droni, caccia, armi teleguidate, carrarmati, «slaughterbots» e altro ancora.

Come riportato da Renovatio 21, lo scorso giugno è stato rivelato che durante una simulazione un sistema di Intelligenza Artificiale dell’aeronautica americana ha agito per uccidere il suo teorico operatore umano. A gennaio era emerso che caccia cinesi alimentati da Intelligenza Artificiale avevano battuto la concorrenza umana in un arco di soli 90 secondi.

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Sito web consente all’Intelligenza Artificiale di affittare esseri umani

Iscriviti al canale Telegram ![]()

Iscriviti alla Newslettera di Renovatio 21

-

Essere genitori2 settimane fa

Essere genitori2 settimane faBambini nella neve, bambini nel bosco: pedolatria olimpica e pedofobia di sistema

-

Bioetica2 settimane fa

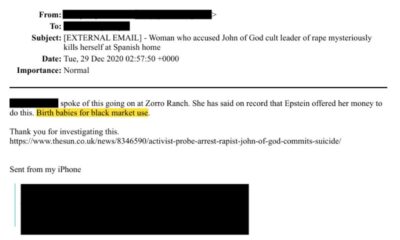

Bioetica2 settimane faAborti traumatici nei file di Epstein

-

Autismo2 settimane fa

Autismo2 settimane faGli scienziati pubblicano una «mappa» su come l’alluminio nei vaccini può causare lesioni cerebrali che scatenano l’autismo

-

Misteri1 settimana fa

Misteri1 settimana faLe porte del pandemonio di Epstein

-

Misteri2 settimane fa

Misteri2 settimane faAllevamenti di bambini al mercato nero: l’orrore emerge dai file di Epstein

-

Spirito7 giorni fa

Spirito7 giorni faMons. Viganò: Roma verso uno scenario apocalittico

-

Pensiero2 settimane fa

Pensiero2 settimane faConsacrazioni FSSPX, non «chi», ma «quanti»: il sogno di un fedele

-

Bizzarria2 settimane fa

Bizzarria2 settimane faGli olimpionici di salto con gli sci indagati per ingrandimento del pene