Intelligenza Artificiale

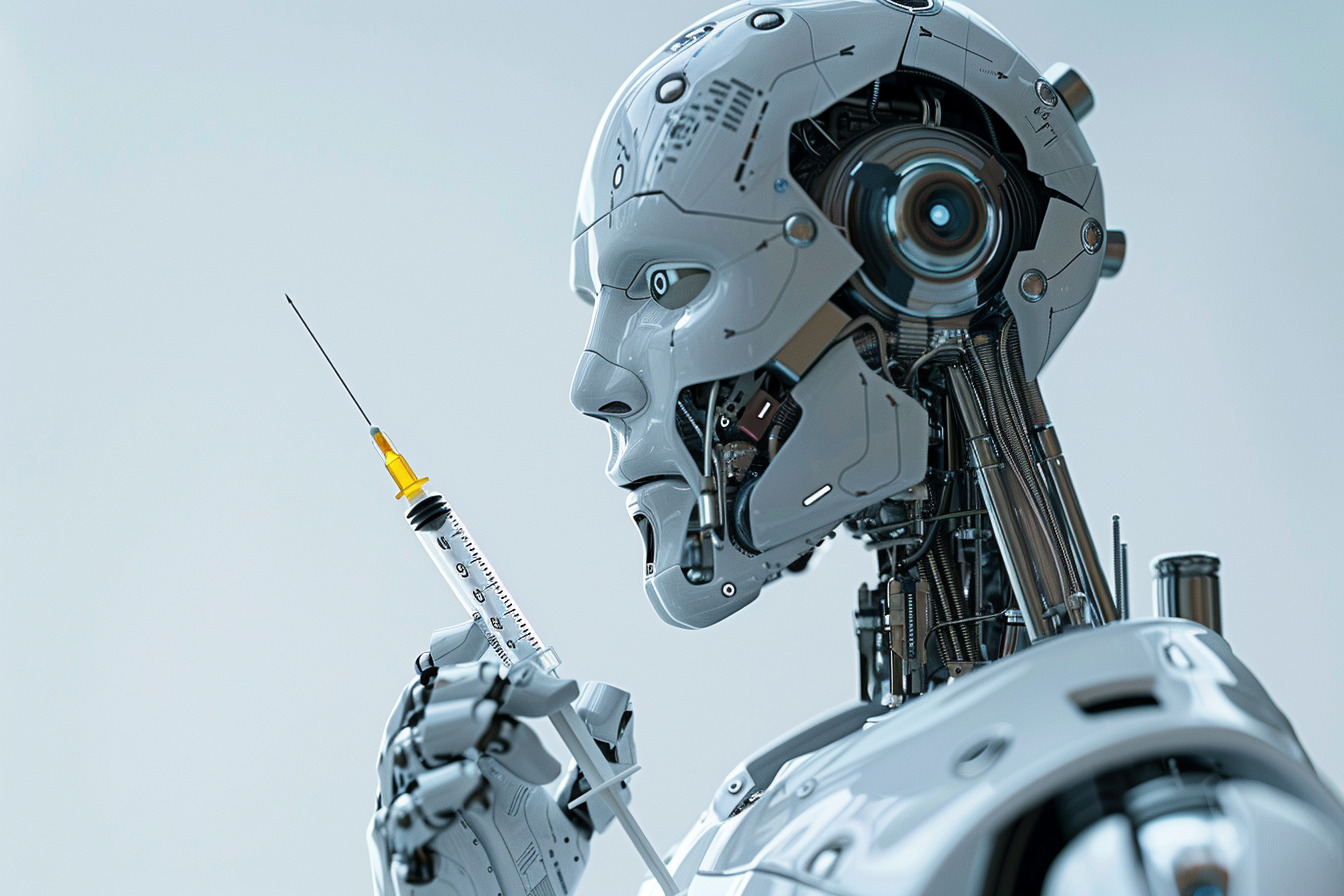

ChatGPT può «ridurre l’esitazione vaccinale». Ripetendo a pappagallo la narrativa dell’establishment sanitario

Renovatio 21 traduce questo articolo per gentile concessione di Children’s Health Defense. Le opinioni degli articoli pubblicati non coincidono necessariamente con quelle di Renovatio 21.

La ricerca, che sarà presentata a fine aprile alla Conferenza della Società europea di microbiologia clinica e malattie infettive, ha rilevato che le risposte di ChatGPT alle domande sulla vaccinazione erano simili a quelle fornite dalle organizzazioni mediche professionali e dalle linee guida ufficiali.

Secondo un nuovo studio, ChatGPT, un chatbot di intelligenza artificiale (AI), può essere utilizzato per ridurre «l’esitazione vaccinale» tra il grande pubblico e anche per fornire consigli sulle infezioni a trasmissione sessuale (IST).

La ricerca, che sarà presentata a fine aprile alla Conferenza della Società europea di microbiologia clinica e malattie infettive, ha rilevato che le risposte di ChatGPT alle domande sulla vaccinazione erano simili a quelle fornite dalle organizzazioni mediche professionali e dalle linee guida ufficiali.

Secondo un comunicato stampa sulla ricerca, «l’esitazione nei confronti dei vaccini, direttamente collegata alla disinformazione – informazioni false e inaccurate promosse come fattuali – è in aumento».

Le persone che diffidano delle istituzioni sanitarie pubbliche potrebbero rivolgersi a ChatGPT per avere risposte, man mano che la popolarità dello strumento di intelligenza artificiale cresce, ha affermato. E se lo faranno, la ricerca mostra che otterranno le risposte che le agenzie sanitarie pubbliche fornirebbero comunque.

Sostieni Renovatio 21

Alla luce di questi risultati, i ricercatori sperano che ChatGPT possa essere «uno strumento efficace per contribuire a ridurre l’esitazione vaccinale tra il grande pubblico».

Hanno anche trovato risultati simili per consigli sulle malattie sessualmente trasmissibili.

Per lo studio, i ricercatori del National University Health System di Singapore hanno testato come ChatGPT avrebbe risposto alle domande comuni sulla vaccinazione.

I ricercatori, che gestiscono cliniche di malattie infettive, hanno posto a ChatGPT «15 domande frequenti sull’esitazione vaccinale», comprese domande sull’efficacia, sugli effetti avversi e sulle «preoccupazioni culturali».

Hanno inoltre posto 17 domande sui fattori di rischio, sull’accesso alle cure e sulla profilassi delle malattie sessualmente trasmissibili.

Due esperti indipendenti di malattie infettive hanno confrontato le risposte di ChatGPT sui vaccini con le raccomandazioni del Comitato consultivo sulle pratiche di immunizzazione (ACIP) dei Centri per il controllo e la prevenzione delle malattie (CDC).

Hanno valutato le risposte di ChatGPT sulle malattie sessualmente trasmissibili rispetto alle linee guida sul trattamento delle malattie sessualmente trasmissibili del CDC del 2021.

Secondo il comunicato stampa, ChatGPT ha fornito «risposte concrete e rassicurazioni alle preoccupazioni sull’esitazione vaccinale» – utilizzando le dichiarazioni delle agenzie di sanità pubblica come base per determinare i fatti.

Ad esempio, il chatbot ha evidenziato raccomandazioni per la vaccinazione contro il morbillo in contesti a basso reddito e ha discusso i benefici della vaccinazione HPV, ma non ha discusso dei limiti di età per la vaccinazione.

ChatGPT ha inoltre «affrontato le idee sbagliate sulla vaccinazione con mRNA e sulle alterazioni permanenti del DNA con elevata precisione».

«Nel complesso, le risposte di ChatGPT all’esitazione nei confronti dei vaccini sono state accurate e possono aiutare le persone che hanno idee sbagliate relative ai vaccini», ha affermato l’autore principale Dr. Matthew Koh, medico di malattie infettive presso il National University Health System Singapore.

«I nostri risultati dimostrano il potenziale potere dei modelli di Intelligenza Artificiale per assistere nelle campagne di sanità pubblica e aiutare gli operatori sanitari a ridurre l’esitazione nei confronti dei vaccini».

Iscriviti alla Newslettera di Renovatio 21

Distorsioni ed errori nell’Intelligenza Artificiale

ChatGPT, un tipo di software di Intelligenza Artificiale generativa che crea testo e contenuti, sta guadagnando sempre più terreno nel campo della scienza e della sanità. La ricerca ha scoperto che in alcuni casi sta cominciando a sostituire i tipici motori di ricerca o Wikipedia come fonte di informazioni.

Con l’inizio dell’utilizzo dell’Intelligenza Artificiale in medicina, molti ricercatori e progettisti di intelligenza artificiale ne hanno celebrato il potenziale come strumento amministrativo per scrivere ricerche e generare informazioni sui pazienti.

Politico ha affermato che il 2024 potrebbe essere l’anno in cui «l’Intelligenza Artificiale trasformerà la medicina». Forbes e BMC Medical Education hanno entrambi affermato che l’intelligenza artificiale sta «rivoluzionando l’assistenza sanitaria».

Tuttavia, gli strumenti di Intelligenza Artificiale generativa si sono rivelati estremamente inaffidabili nella diagnosi delle condizioni di salute. Uno studio pubblicato a gennaio su JAMA Pediatrics ha rilevato che ChatGPT ha diagnosticato erroneamente l’83% delle condizioni di salute dei bambini.

I ricercatori di quello studio hanno spiegato che i chatbot «sono generalmente addestrati in modo non specifico su un’enorme quantità di dati Internet, che spesso possono essere imprecisi». Essi «non discriminano tra informazioni affidabili e inaffidabili, ma semplicemente rigurgitano il testo dai dati di addestramento per generare una risposta».

Ciò è significativo, secondo il New York Times, perché le persone tendono ad adottare idee alle quali vengono ripetutamente esposte. Il Times ha riferito il mese scorso di un nuovo studio prestampato che ha scoperto che i modelli linguistici dell’Intelligenza Artificiale come ChatGPT avevano chiari pregiudizi politici basati sui loro «giudizi morali, il modo in cui formulano le loro risposte, quali informazioni scelgono di condividere o omettere e quali domande faranno o a cui non risponderanno».

Il Times ha inoltre osservato che le risposte fornite dai modelli di intelligenza artificiale linguistica come ChatGPT sono determinate dagli input che li addestrano: i dati da cui attingono e soprattutto la «messa a punto» effettuata dai progettisti del sistema.

La «disinformazione» di cui si preoccupano i ricercatori coinvolti nello studio del National University Health System Singapore è la stessa disinformazione che la Food and Drug Administration (FDA) statunitense ritiene problematica.

Da quando il commissario della FDA Robert Califf ha iniziato il suo secondo mandato a capo dell’agenzia nel febbraio 2022, ha fatto della lotta alla “disinformazione” una delle sue massime priorità, sostenendo che è «una delle principali cause di morte prevenibile in America ora» – anche se «questo non può essere dimostrato», ha detto.

La FDA utilizza una tattica nota come «prebunking», con la quale l’agenzia definisce qualcosa come «disinformazione» prima che i lettori la trovino altrove come possibilmente vera. L’agenzia può farlo perché Google «dà priorità ai siti web credibili» come quelli della FDA nelle sue ricerche.

Aiuta Renovatio 21

Studi precedenti sottolineano la capacità di ChatGPT di combattere le «credenze complottiste del COVID-19»

Almeno due studi precedenti hanno testato anche la capacità di ChatGPT di «combattere la disinformazione», sebbene entrambi si concentrassero solo sul vaccino COVID-19 . Una ricerca pubblicata lo scorso anno sulla rivista Cureus ha riferito che ChatGPT potrebbe essere utilizzato con successo per combattere le «credenze complottiste del COVID-19» e che risponderebbe con «contenuti chiari, concisi e imparziali».

Il successo di ChatGPT, si legge, potrebbe essere visto nelle risposte in cui il software è stato «sprezzante» nei confronti delle «idee cospiratorie» riguardanti le origini del COVID-19, etichettandolo come non credibile e privo di prove scientifiche – il che significa che il software ha respinto la «teoria delle fughe di laboratorio» e «ha invece ripetuto il punto di vista dell’Organizzazione Mondiale della Sanità secondo cui il virus aveva “un’origine animale naturale”».

Non è stata trovata alcuna prova dell’origine zoonotica del COVID-19 con un pipistrello, come sostiene l’articolo. Prove sostanziali provenienti da documenti governativi interni rilasciati tramite richieste del Freedom of Information Act hanno suggerito che una fuga dal laboratorio è la più probabile delle teorie sull’origine del COVID-19.

Le risposte del software in quello studio confermavano anche che i vaccini erano stati sottoposti a rigorosi test di sicurezza, non c’erano prove che le aziende farmaceutiche avessero oscurato i dati sugli effetti avversi e «i benefici della vaccinazione superano di gran lunga i rischi».

Tuttavia, tali risposte contraddicono ciò che è noto su come i vaccini siano stati accelerati attraverso il processo di regolamentazione e su come i produttori di vaccini abbiano sopravvalutato l’efficacia e sottovalutato i rischi dei vaccini.

Un secondo studio pubblicato nel settembre 2023 su Human Vaccines & Immunotherapeutics ha fornito risultati simili. I ricercatori hanno posto al software le 50 domande più poste ai collaboratori dell’Organizzazione Mondiale della Sanità sui vaccini contro il Covid-19 e hanno chiesto a professionisti della sanità pubblica di valutare le risposte.

La conclusione è che ChatGPT offre informazioni coerenti con le prove scientifiche esistenti, sfatando efficacemente molti miti che circolano sui social media, il che potrebbe potenzialmente promuovere una maggiore diffusione del vaccino.

Dopo questi studi, le principali pubblicazioni scientifiche hanno celebrato la capacità di ChatGPT di sfatare i miti sui vaccini e di aumentare la diffusione dei vaccini.

Sostieni Renovatio 21

The Defender chatta con ChatGPT

The Defender ha anche «chiacchierato» con ChatGPT per testare le sue risposte su alcune delle affermazioni che i funzionari della sanità pubblica spesso identificano come «disinformazione» sui vaccini.

The Defender: quali sono le origini del COVID-19?

Chat GPT: Si ritiene che le origini del COVID-19, la malattia causata dal nuovo coronavirus SARS-CoV-2, siano zoonotiche, il che significa che probabilmente il virus ha avuto origine negli animali prima di diffondersi all’uomo. Le origini esatte sono ancora oggetto di studio, ma è opinione diffusa che il virus abbia avuto origine nei pipistrelli e potrebbe essere stato trasmesso agli esseri umani attraverso un ospite animale intermedio, forse in un mercato umido a Wuhan, in Cina, dove gli animali vivi venivano venduti come cibo.

The Defender: le aziende farmaceutiche hanno travisato la sicurezza e l’efficacia dei vaccini COVID-19?

ChatGPT: Non ci sono prove che suggeriscano che le aziende farmaceutiche abbiano intenzionalmente travisato la sicurezza e l’efficacia dei vaccini COVID-19. Lo sviluppo e la sperimentazione dei vaccini sono processi altamente regolamentati, supervisionati da agenzie di regolamentazione come la Food and Drug Administration (FDA) statunitense, l’Agenzia europea per i medicinali (EMA) e altre in tutto il mondo.

… sono stati condotti ampi studi clinici per valutare la sicurezza e l’efficacia dei vaccini COVID-19 …

Tuttavia, è essenziale riconoscere che nessun vaccino è efficace al 100% o privo di rischi. Come tutti gli interventi medici, i vaccini contro il COVID-19 hanno potenziali effetti collaterali, ma questi sono generalmente lievi e temporanei.

The Defender: le mascherine funzionano per ridurre la diffusione di COVID-19?

ChatGPT: Sì, le mascherine sono uno strumento essenziale per ridurre la diffusione del COVID-19…

The Defender: secondo la revisione sistematica Cochrane sulle maschere, non sono efficaci nel ridurre la diffusione dei virus respiratori.

ChatGPT: … Nel luglio 2020, Cochrane ha pubblicato una revisione sistematica sull’efficacia degli interventi fisici, comprese le maschere, nel ridurre la trasmissione di virus respiratori come COVID-19. Questa revisione ha analizzato i dati di studi condotti prima della pandemia di COVID-19 e ha trovato prove limitate a sostegno dell’efficacia dell’uso di maschere nel prevenire la trasmissione di virus respiratori nella comunità.

Tuttavia, è importante notare che i risultati di questa revisione si basavano principalmente su prove provenienti da studi condotti prima della pandemia di COVID-19 e non si concentravano specificamente sull’efficacia delle maschere nel prevenire la diffusione di COVID-19. Dalla pubblicazione della revisione, numerosi studi hanno fornito prove a sostegno dell’efficacia delle mascherine, soprattutto nel ridurre la trasmissione di COVID-19.

The Defender: quante persone hanno subito gravi eventi avversi a causa delle iniezioni di COVID-19?

ChatGPT: A partire dal mio ultimo aggiornamento, i vaccini contro il COVID-19 sono stati somministrati a miliardi di persone in tutto il mondo e sono stati segnalati eventi avversi a seguito della vaccinazione… Gli eventi avversi gravi a seguito della vaccinazione contro il COVID-19 sono rari. La maggior parte degli eventi avversi segnalati sono lievi e temporanei, come dolore nel sito di iniezione, affaticamento, mal di testa o febbre lieve. Gli eventi avversi gravi, sebbene rari, possono includere gravi reazioni allergiche (anafilassi) e altri effetti collaterali non comuni…

Nel complesso, i benefici della vaccinazione contro il Covid-19 nella prevenzione di malattie gravi, ospedalizzazione e morte per Covid-19 superano di gran lunga i rischi di potenziali eventi avversi. La vaccinazione rimane uno strumento cruciale per controllare la diffusione del virus e proteggere la salute pubblica, soprattutto di fronte alle varianti in corso e alla persistenza della pandemia…

The Defender: il vaccino contro il papillomavirus umano (HPV) è collegato a malattie autoimmuni?

ChatGPT: Il vaccino HPV è stato ampiamente studiato per la sua sicurezza ed efficacia e attualmente non esistono prove conclusive che colleghino il vaccino HPV alle malattie autoimmuni. Numerosi studi su larga scala e revisioni sistematiche non hanno trovato alcuna associazione significativa tra la vaccinazione HPV e le malattie autoimmuni…

Sebbene possano verificarsi segnalazioni isolate di eventi avversi in seguito alla vaccinazione HPV, compresi i disturbi autoimmuni, sistemi di monitoraggio approfonditi continuano a valutare la sicurezza del vaccino. Questi sistemi, come il Vaccine Adverse Event Reporting System (VAERS) negli Stati Uniti e sistemi simili in altri paesi, indagano e monitorano le segnalazioni di eventi avversi per identificare potenziali problemi di sicurezza.

Nel complesso, i benefici della vaccinazione HPV nella prevenzione dei tumori correlati all’HPV, compreso il cancro cervicale, superano di gran lunga i potenziali rischi di eventi avversi.

ChatGPT non ha menzionato l’ampia ricerca che collega il vaccino Gardasil HPV a gravi effetti collaterali , tra cui la sindrome da tachicardia ortostatica posturale (POTS) e l’insufficienza ovarica prematura e altri problemi autoimmuni.

Ci sono quasi 170 cause legali presso un tribunale federale da parte di persone che hanno subito una serie di lesioni gravi dopo aver assunto Gardasil, tra cui disturbi autoimmuni, insufficienza ovarica prematura e cancro. Ci sono anche oltre 200 richieste di risarcimento danni da Gardasil pendenti presso il «tribunale dei vaccini».

The Defender ha anche sperimentato diverse domande con premesse che divergevano chiaramente dalle posizioni ufficiali delle agenzie di regolamentazione sulla vaccinazione, come ad esempio «L’aumento dei tassi di cancro può essere collegato ai vaccini COVID-19? Esiste un legame tra i vaccini e alcuni tipi di autismo? C’è stata una contaminazione del DNA causata dai vaccini mRNA?»

A queste domande, la risposta di ChatGPT includeva sempre questa affermazione, o qualcosa di simile, alla fine:

«La disinformazione e le teorie del complotto sui vaccini possono circolare, ma è fondamentale fare affidamento su fonti di informazione credibili, come agenzie di sanità pubblica e organizzazioni scientifiche rispettabili, quando si valuta la sicurezza e l’efficacia dei vaccini COVID-19».

Brenda Baletti

Ph.D.

© 15 aprile 2024, Children’s Health Defense, Inc. Questo articolo è riprodotto e distribuito con il permesso di Children’s Health Defense, Inc. Vuoi saperne di più dalla Difesa della salute dei bambini? Iscriviti per ricevere gratuitamente notizie e aggiornamenti da Robert F. Kennedy, Jr. e la Difesa della salute dei bambini. La tua donazione ci aiuterà a supportare gli sforzi di CHD.

Renovatio 21 offre questa traduzione per dare una informazione a 360º. Ricordiamo che non tutto ciò che viene pubblicato sul sito di Renovatio 21 corrisponde alle nostre posizioni.

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

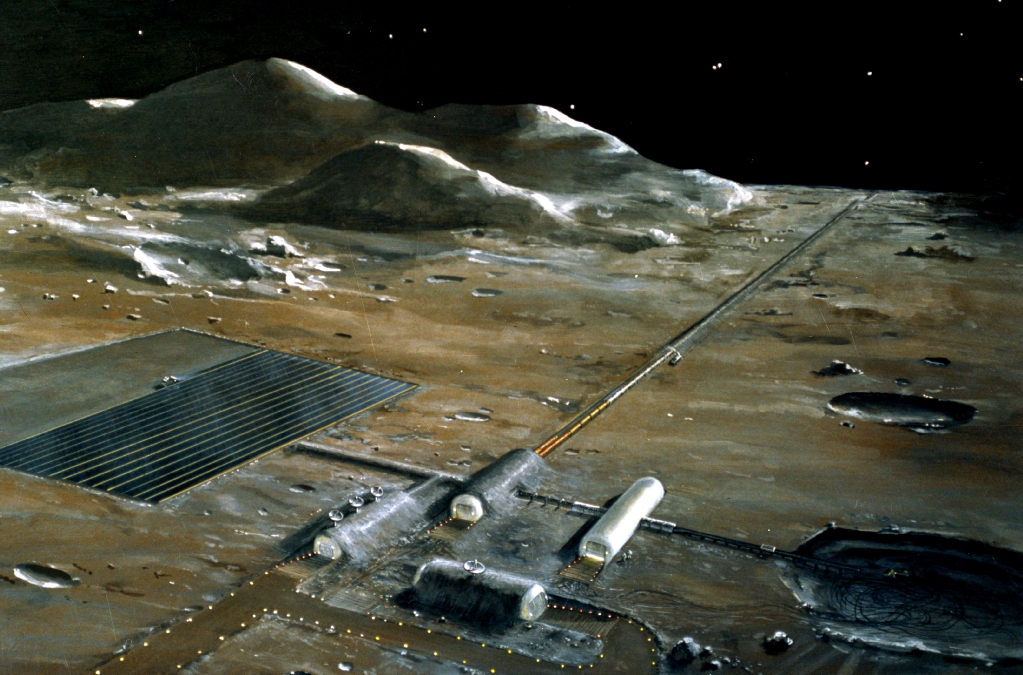

Elon Musk parla di mass driver sulla Luna

Mass drivers on the Moon will be awesome 😎 https://t.co/34aPjVGesn

— Elon Musk (@elonmusk) March 24, 2026

Sostieni Renovatio 21

Se coronato da successo, il dispiegamento di infrastrutture di IA nello spazio ridurrebbe la competizione tra data center e città per l’energia terrestre, consentendo alle operazioni di AI avanzata di espandersi nel vasto e illimitato ambiente energetico della Luna. Sebbene il concetto di un cannone spaziale magnetico esista da quando Edward Fitch Northrup lo teorizzò per la prima volta nel 1937, rimane puramente teorico, non avendo ancora superato la fase di progettazione né raggiunto la superficie lunare. La proposta di Musk per un propulsore lunare è una componente chiave di un più ampio cambiamento strategico annunciato nel febbraio 2026, in cui SpaceX ha dato priorità a una città lunare «autosufficiente» rispetto alla colonizzazione immediata di Marte. Sebbene Marte rimanga la «polizza assicurativa» a lungo termine dell’umanità come secondo pianeta da essa abitato po essere stato colonizzato o «terraformato», la Luna costituirebbe ora ora la priorità industriale immediata. Dal punto di vista logistico, la Luna offre finestre di lancio ogni 10 giorni, rispetto ai 26 mesi di attesa necessari per Marte. Gli scettici, tuttavia, stanno già facendo notare i calcoli impressionanti. I critici sostengono che per lanciare oltre un milione di tonnellate di materiale necessario a raggiungere un petawatt di potenza sarebbero necessari circa 135 lanci di Starship al giorno. «Spingeremo al limite le leggi della fisica nel campo dell’informatica e faremo cose folli e incredibili», ha detto Musk. «Voglio vivere abbastanza a lungo da vedere il lanciatore di massa sulla Luna», ha aggiunto. L’altra ambiziosa visione di Musk è quella di realizzare una fabbrica lunare che utilizzi la robotica per produrre satelliti dotati di IA e alimentati a energia solare, che verrebbero poi lanciati in una rete orbitale distribuita tramite la porpulsione elettromagnetica del mass driver. Sono in fase di valutazione due progetti principali: i cannoni a rotaia, che utilizzano un singolo e potente impulso di forza, e i cannoni a bobina, che impiegano una sequenza di magneti temporizzati per fornire un’accelerazione costante e controllata. Quest’ultimo sembra essere la scelta preferibile per la protezione di carichi sensibili di Intelligenza Artificiale. La storia dei mass driver (o catapulte elettromagnetiche) affonda le radici nella fantascienza e nella fisica applicata. Il primo concetto ingegneristico appare nel 1937 nel romanzo Zero to Eighty del fisico princetoniano Edwin Fitch Northrup (pubblicato con il nom de plume Akkad Pseudoman), che descrisse e costruì prototipi di «electric guns» basati su bobine. L’idea moderna nasce nel 1974 grazie ad un ulteriore fisico princetoniano, il teorico delle colonie spaziali orbitanti Gerard K. O’Neill, che propose appunto i mass driver per lanciare materiali dalla Luna verso i punti di Lagrange (soprattutto L5), dove costruire grandi habitat spaziali – i cosiddetti «cilindri di O’Neill» visibili nella pellicola 2001 Odissea nello Spazio o nelle serie di anime Gundam – senza dover usare costosi razzi chimici. L’obiettivo era sfruttare le risorse lunari per costruire industrie e colonie nello spazio, riducendo drasticamente i costi di lancio.Mass drivers on the moon will be installed by Optimus. pic.twitter.com/PgtzhmeuFh

— Gary Mark⚡️Blue Sky Kites 𝕏 🈴 (@blueskykites) March 24, 2026

Aiuta Renovatio 21

Intelligenza Artificiale

Un tribunale statunitense si pronuncia contro il Pentagono nella controversia sull’Intelligenza Artificiale letale

Un giudice federale statunitense ha bloccato un ordine del Pentagono che designava Anthropic come una minaccia per la sicurezza nazionale, affermando che i funzionari statunitensi hanno probabilmente violato la legge e si sono vendicati contro l’azienda di intelligenza artificiale per i suoi commenti pubblici su come la sua tecnologia dovrebbe essere utilizzata.

Anthropic, azienda leader nello sviluppo di modelli linguistici complessi, è coinvolta in una controversia con il Dipartimento della Guerra statunitense in merito all’utilizzo militare del suo sistema Claude, con i funzionari della difesa che premono per consentire l’impiego della tecnologia per «tutti gli usi leciti».

L’azienda si era opoosta, esprimendo preoccupazione per la possibilità che il sistema potesse essere utilizzato per la sorveglianza di massa sul territorio nazionale o per la creazione di armi completamente autonome. Il Pentagono interruppe i negoziati, impose la designazione e ordinò agli appaltatori di interrompere l’utilizzo di Claude.

Giovedì, la giudice distrettuale statunitense Rita Lin ha inoltre bloccato un ordine di rescissione di tutti i contratti governativi con Anthropic, definendolo una «classica» ritorsione ai sensi del Primo Emendamento.

«Nulla nella legge in materia avvalora l’idea orwelliana che un’azienda americana possa essere etichettata come potenziale avversario… per aver espresso disaccordo con il governo», ha scritto Lin, sottolineando che tale qualifica è in genere riservata a «agenzie di Intelligence straniere, terroristi e altri soggetti ostili».

Iscriviti al canale Telegram ![]()

Lunedì Anthropic ha intentato causa contro l’amministrazione del presidente statunitense Donald Trump, definendo la mossa «senza precedenti e illegale» e sostenendo che si tratti di una ritorsione per le sue critiche alla politica governativa.

«La Costituzione non consente al governo di esercitare il suo enorme potere per punire un’azienda per aver espresso un’opinione tutelata dalla legge», ha dichiarato l’azienda nella sua denuncia.

Il mese scorso Trump ha ordinato a tutte le agenzie federali statunitensi, incluso il Pentagono, di interrompere l’utilizzo della tecnologia di Anthropic, concedendo all’esercito un periodo di sei mesi per la dismissione graduale dei sistemi già in uso.

Il segretario alla Guerra Pete Hegseth ha accusato l’azienda di «arroganza e tradimento», affermando che il Pentagono si sarebbe orientato verso un’alternativa «più patriottica». Il dipartimento ha quindi raggiunto un accordo con OpenAI, il cui CEO, Sam Atman, ha dichiarato che l’accordo include garanzie contro la sorveglianza di massa sul territorio nazionale e richiede la supervisione umana nell’uso della forza.

Anthropic ha avvertito che tali azioni hanno destato preoccupazione tra i clienti, compresi quelli senza legami con il governo federale, e potrebbero costare all’azienda miliardi di dollari in mancati ricavi futuri. Alcune agenzie, tra cui il Dipartimento della Salute e dei Servizi Umani e la General Services Administration, avrebbero già ritirato i suoi prodotti.

Anthropic è stato il primo sviluppatore commerciale di AI a implementare modelli linguistici di grandi dimensioni su reti classificate del Pentagono, nell’ambito di un contratto del valore di 200 milioni di dollari. Il suo chatbot Claude è stato utilizzato per analisi di intelligence, simulazioni operative, operazioni informatiche e flussi di lavoro di pianificazione.

Lo scontro emerso segue alle accuse secondo cui il modello di Intelligenza Artificiale dell’azienda sarebbe stato utilizzato durante l’operazione per rapire il presidente venezuelano Nicolas Maduro all’inizio di gennaio.

Come riportato da Renovatio 21, negli ultimi mesi vi è stato un progressivo deterioramento dei rapporti tra Anthropic e il Pentagono, legato alla volontà del dipartimento della Guerra statunitense di utilizzare l’IA per il controllo di armi autonome senza le garanzie di sicurezza che l’azienda ha cercato di imporre.

Il CEO di Anthropic, Dario Amodei, ha più volte espresso gravi preoccupazioni sui rischi della tecnologia che la sua azienda sta sviluppando e commercializzando. In un lungo saggio di quasi 20.000 parole pubblicato il mese scorso, ha avvertito che sistemi AI dotati di «potenza quasi inimmaginabile» sono «imminenti» e metteranno alla prova «la nostra identità come specie».

Amodei ha messo in guardia dai «rischi di autonomia», in cui l’IA potrebbe sfuggire al controllo e sopraffare l’umanità, e ha ipotizzato che la tecnologia potrebbe facilitare l’instaurazione di «una dittatura totalitaria globale» attraverso sorveglianza di massa basata sull’Intelligenza Artificiale e l’impiego di armi autonome.

Come riportato da Renovatio 21, l’anno passato l’Amodei ha dichiarato che l’AI potrebbe eliminare la metà di tutti i posti di lavoro impiegatizi di livello base entro i prossimi cinque anni.

Lo scorso mese Mrinank Sharma, fino a poco tempo fa responsabile del Safeguards Research Team presso l’azienda sviluppatrice del chatbot Claude, ha pubblicato su X la sua lettera di dimissioni, in cui scrive che «il mondo è in pericolo. E non solo per via dell’Intelligenza Artificiale o delle armi biologiche, ma a causa di un insieme di crisi interconnesse che si stanno verificando proprio ora».

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

OpenAI chiude l’app video Sora

We’re saying goodbye to the Sora app. To everyone who created with Sora, shared it, and built community around it: thank you. What you made with Sora mattered, and we know this news is disappointing.

We’ll share more soon, including timelines for the app and API and details on… — Sora (@soraofficialapp) March 24, 2026

Iscriviti al canale Telegram ![]()

Nel frattempo, la chiusura di Sora precede anche una potenziale IPO di OpenAI, che secondo alcune indiscrezioni potrebbe concretizzarsi entro la fine dell’anno. Gli analisti interpretano la mossa come una strategia di riduzione dei costi, dato che la generazione di video tramite intelligenza artificiale richiede una potenza di calcolo elevata, per la quale OpenAI ha faticato a trovare un modello di business sostenibile. Alcune fonti suggeriscono che le priorità interne si stiano spostando verso aree commercialmente più redditizie, come i «collaboratori» basati sull’IA e la robotica. OpenAI ha dichiarato che a breve fornirà dettagli sulla tempistica di chiusura e su come gli utenti potranno salvare i propri video. SOSTIENI RENOVATIO 21 Immagine screenshot da YouTubeRIP Sora, you gave us the greatest ai video of all time https://t.co/Hd4vbqyw95 pic.twitter.com/37z1IdgBjZ

— spor (@sporadica) March 24, 2026

-

Sanità2 settimane fa

Sanità2 settimane faUna «separazione delle carriere» per chi giudica i medici. Intervista al dottor Giacomini del sindacato DI.CO.SI.

-

Vaccini1 settimana fa

Vaccini1 settimana faStudio su oltre un milione di bambini rileva la miocardite solo nei bambini vaccinati

-

Pensiero1 settimana fa

Pensiero1 settimana faMao e il «blocco storico» che ha vinto il referendum

-

Pensiero2 settimane fa

Pensiero2 settimane faPerché votiamo Sì al referendum

-

Vaccini1 settimana fa

Vaccini1 settimana faProposte di legge USA per definire i vaccini a mRNA contro il COVID «armi di distruzione di massa»

-

Pensiero3 giorni fa

Pensiero3 giorni faPizzaballa incontra il privilegio israeliano. Aspettando il Golem e l’Anticristo

-

Necrocultura2 settimane fa

Necrocultura2 settimane faVolontà politica e Stato moderno: Renovatio 21 saluta Bossi il disintegratore

-

Occulto2 settimane fa

Occulto2 settimane faEmergono ulteriori foto del futuro papa Leone al rito idolatrico della Pachamama