Intelligenza Artificiale

13enne diviene l’unico essere umano a finire Tetris, il gioco che il padre di Ghislaine Maxwell avrebbe voluto comprare

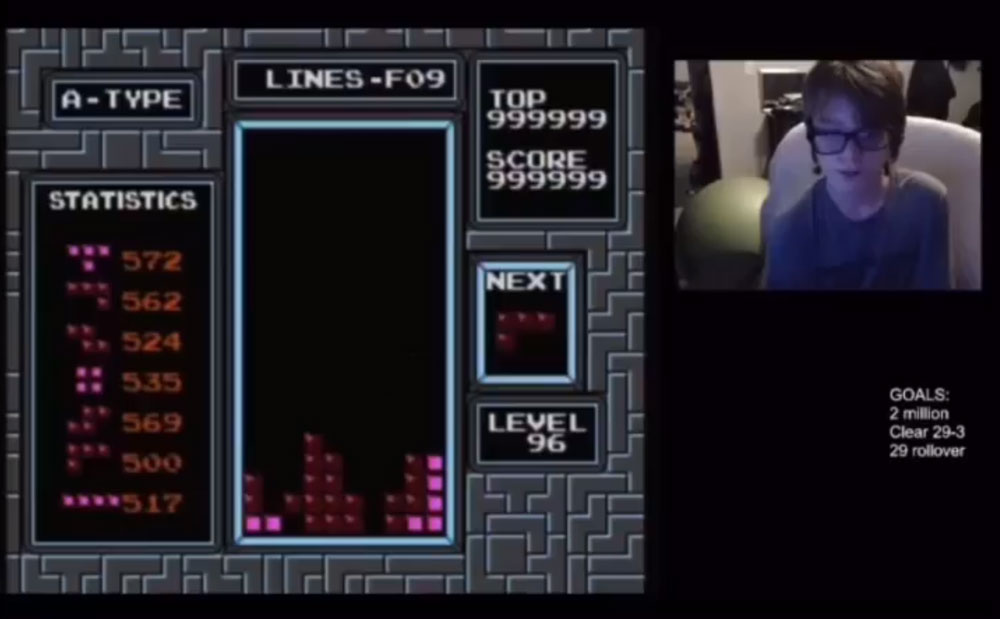

Il tredicenne dell’Oklahoma Willis Gibson è diventato il primo essere umano ad aver battuto il videogioco Tetris, più di tre decenni dopo la sua prima uscita sul mercato.

Il giovane Gibson, conosciuto online con il soprannome di «Blue Scuti», ha pubblicato online un video del suo risultato da record dopo aver impiegato solo 38 minuti per raggiungere il livello 157, prima che si il gioco si fermasse con il cosiddetto «kill screen», cioè la schermata di fatto conclusione del gioco. Il suo punteggio già segnava «999999» punti.

«Per favore, vai in crash», dice il Gibson nel video mentre completa un’altra linea di blocchi che cadono, poco prima che il gioco si blocchi definitivamente. «Oh my God!» esclama. «Sì! Sto per svenire. Non riesco a sentire le mie mani».

13 year old Willis Gibson aka Blue Scuti became the first recorded person to beat Tetris causing the game to freeze after reaching level 157 pic.twitter.com/uRt3KOasTh

— Jake Lucky (@JakeSucky) January 4, 2024

Sostieni Renovatio 21

Solo fino a pochi anni fa si riteneva possibile avanzare al livello 29. In precedenza, solo bot di intelligenza artificiale appositamente progettati erano in grado di forzare il gioco alla schermata finale.

«Non è mai stato fatto da un essere umano prima», ha detto mercoledì Vince Clemente, presidente del Campionato mondiale di Tetris classico, riporta il New York Times. «Fondamentalmente è qualcosa che tutti pensavano fosse impossibile fino a un paio di anni fa».

Gibson, che mantiene le sue abilità nel Tetris con circa 20 ore di pratica a settimana, è diventato uno dei migliori giocatori competitivi degli Stati Uniti da quando ha iniziato a giocare solo due anni fa.

«Quando ho iniziato a giocare non mi sarei mai aspettato di finirlo», ha scritto sul suo canale YouTube. Gibson afferma inoltre di aver battuto il record di punteggio complessivo, così come altri tre record mondiali di Tetris. Il ragazzo ha dedicato il suo successo al defunto padre Adam, scomparso il mese scorso.

Tetris presenta una serie di blocchi che cadono che un giocatore deve disporre in linee orizzontali a velocità sempre più incredibili. L’iconico gioco ha confuso i giocatori sin dalla sua uscita 34 anni fa sulle console Nintendo, dopo essere stato creato dall’ingegnere sovietico Alexei Pajitnov nel 1984.

È considerato uno dei videogiochi più amati e duraturi della storia e rimane popolare fino ai giorni nostri, con una nuova generazione di giocatori che partecipano su console e telefoni cellulari.

La storia della cessione dei diritti del Tetris dallo Stato sovietico in disfacimento alla Nintendo è raccontata nella recente pellicola Tetris (2023), che mette in scena gli sforzi del mediatore americano Henk Rogers che si trova a fronteggiare non solo la cupidigia di agenti sovietici corrotti, ma anche la concorrenza sleale di Robert Maxwell, il magnate dei media e bancarottiere padre della madame di Epstein Ghislaine Maxwell.

Maxwell, che poteva vantare rapporti diretti con Gorbachev, stava affrontando gli scandali per le frodi che trascinarono nel fango il suo impero economico. Secondo la pellicola, Maxwell inizialmente aveva mandato avanti a trattare uno dei suoi dieci figli, che però era all’oscuro dei magheggi del padre. Il caso di Ghislaine, che si dice fosse la figlia preferita, è diverso: molti dicono che abbia ereditato dal padre il ruolo di spia per i servizi israeliani, per i quali Maxwell senior secondo un libro di Sy Hersh – The Samson Option – avrebbe trafficato, tra le altre cose, segreti atomici: secondo il reporter premio Pulitzer, fu Maxwell ad avvisare gli israeliani delle intenzioni del fisico nucleare Vanunu, poi rapito a Roma nel 1986 e sparito per molti anni.

Maxwell senior, che scomparve una notte nell’oceano dal suo panfilo che si chiamava proprio Ghislaine come l’amata figlia ora in carcere, nonostante le aderenze con le altissime sfere sovietiche non ottenne la licenza per la diffusione del gioco sul mercato mondiale: la spuntò la Nintendo, che accluse il gioco alla sua rivoluzionaria console tascabile in fase di lancio – il mitico Gameboy – cambiando per sempre la storia dei videogiochi.

Iscriviti alla Newslettera di Renovatio 21

Immagine screenshot da Twitter

Intelligenza Artificiale

Esperti di AI mettono in guardia dai pericoli del «comportamento strategico emergente».

Iscriviti al canale Telegram ![]()

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Scienziato crea un vaccino mRNA per il suo cane usando l’AI

Uno scienziato informatico australiano ha impiegato ChatGPT e Grok per sviluppare una potenziale cura per la sua cagnolina, alla quale era stato diagnosticato un tumore in fase acuta.

Due anni fa, a Rosie, la cagnolina meticcia di Staffordshire Bull Terrier e Shar Pei di Paul Conyngham, è stata diagnosticata una forma aggressiva di mastocitoma, una patologia che colpisce i cani. La chirurgia veterinaria e la chemioterapia hanno rallentato la progressione dei tumori, ma non sono riuscite a ridurne le dimensioni.

Il Conyngham, ingegnere elettrico e informatico nonché cofondatore di Core Intelligence Technologies, si è rivolto a ChatGPT per elaborare possibili trattamenti, prima di sfruttare la sua esperienza nell’analisi dei dati per identificare le mutazioni nel tumore, mappare le proteine alterate mediante AlphaFold e abbinare i potenziali bersagli ai farmaci.

«Il primo passo è stato contattare l’università per far sequenziare il DNA di Rosie. L’idea è di prelevare il DNA sano dal suo sangue e poi il DNA dal suo tumore e sequenziarli entrambi per vedere esattamente dove si sono verificate le mutazioni», ha detto all’Australian.

Iscriviti alla Newslettera di Renovatio 21

I ricercatori del Ramaciotti Centre for Genomics dell’UNSW hanno collaborato al sequenziamento del DNA di Rosie, mentre gli scienziati hanno utilizzato il modello di mRNA elaborato da Conyngham per sintetizzare la nanoparticella del vaccino. Il trattamento è stato somministrato dalla veterinaria oncologa professoressa Rachel Allavena dell’Università del Queensland, che ha supervisionato la terapia sperimentale.

Rosie ha ricevuto la prima iniezione a dicembre, seguita da una dose di richiamo il mese successivo. Nonostante il tumore fosse in stadio avanzato, le condizioni della cagnolina sono migliorate nel giro di poche settimane dall’inizio del trattamento, con una massa tumorale che si è ridotta di quasi la metà. A quanto pare, Rosie ora appare più sana e piena di energia.

Gli scienziati stanno ora sequenziando nuovamente il tumore per progettare un secondo vaccino mirato alle cellule cancerose che non hanno risposto al primo trattamento.

L’inquietante episodio mostra come siano in fase di sviluppo vaccini oncologici personalizzati a mRNA, anche per uso umano.

Come riportato da Renovatio 21, l’intreccio tra AI e sieri genici personalizzati era stata oscuramente annunziato dal miliardario informatico sionista Larry Ellison durante un incontro alla Casa Bianca nelle primissime ore della seconda presidenza Trump che proclamava l’avvio del progetto per lo sviluppo dell’IA detto «Stargate».

«Una delle cose più entusiasmanti su cui stiamo lavorando utilizzando gli strumenti forniti da Sam [Altman] e [Masayoshi Son] è un vaccino contro il cancro», aveva affermato l’Ellison con a fianco il presidente Trump. «A quanto pare, tutti i nostri tumori, i tumori cancerosi, piccoli frammenti di quei tumori fluttuano nel sangue. Quindi puoi fare una diagnosi precoce del cancro con un esame del sangue. E usando l’intelligenza artificiale per guardare l’esame del sangue, puoi trovare i tumori che in realtà minacciano seriamente la persona».

Aiuta Renovatio 21

«La diagnosi del cancro tramite Intelligenza Artificiale promette di essere semplicemente un esame del sangue», aveva continuato Ellison. «Quindi, una volta che abbiamo sequenziato il gene di quel tumore canceroso, puoi vaccinare la persona, progettare un vaccino per ogni singola persona per vaccinarla contro quel cancro».

«E puoi realizzare quel vaccino mRNA, puoi realizzarlo roboticamente con l’uso dell’IA in circa 48 ore», ha aggiunto l’ultramiliardario, da anni stabilmente nella top ten dei più ricchi del pianeta. «Questa è la promessa dell’IA e la promessa del futuro».

Come sottolineato negli anni da Renovatio 21, se non sarà posto un limite, ogni vaccino, in realtà ogni «cura» dell’organismo umano e non, passerà per la genetica, con sieri DNA, RNA, mRNA, microRNA, circRNA, etc.

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Soldati umanoidi testati in Ucraina

Iscriviti al canale Telegram ![]()

Aiuta Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

-

Bioetica2 settimane fa

Bioetica2 settimane faCirconcisione, scoppia l’incidente diplomatico: il Belgio convoca l’ambasciatore americano

-

Morte cerebrale2 settimane fa

Morte cerebrale2 settimane faIl bambino con il cuore «bruciato» e la tremenda verità sui numeri dei trapianti falliti

-

Spirito4 giorni fa

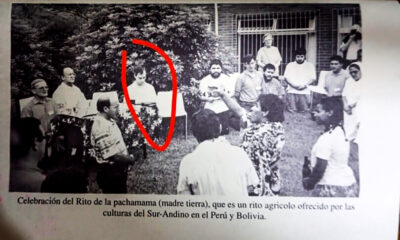

Spirito4 giorni faFoto del 1995 mostra Leone XIV mentre partecipa al rituale idolatrico della Pachamama

-

Vaccini2 settimane fa

Vaccini2 settimane faEsperti affrontano la questione della «massiccia epidemia di danni da vaccino»

-

Pensiero1 settimana fa

Pensiero1 settimana faVerso la legge che fa dell’antisemitismo una nuova categoria dello spirito

-

Senza categoria1 settimana fa

Senza categoria1 settimana faMons. Viganò sta con la famiglia nel bosco. Ma perché lo Stato si sta accanendo in questo modo?

-

Eugenetica2 settimane fa

Eugenetica2 settimane fa«Organi e sperma prelevati dai corpi» nel ranch di Epstein

-

Immigrazione2 settimane fa

Immigrazione2 settimane faIl cardinale Zuppi va all’evento del Ramadan. Poi si preoccupa per le zero iscrizioni al catechismo e la mancanza di famiglie cattoliche